` が含まれている必要があります。

以下に curl コマンドでリクエストヘッダーを指定する例を示します。

```bash

curl -X POST ENDPOINT_URL \

-H "Authorization: Bearer YOUR_SKYWAY_ADMIN_AUTH_TOKEN"

```

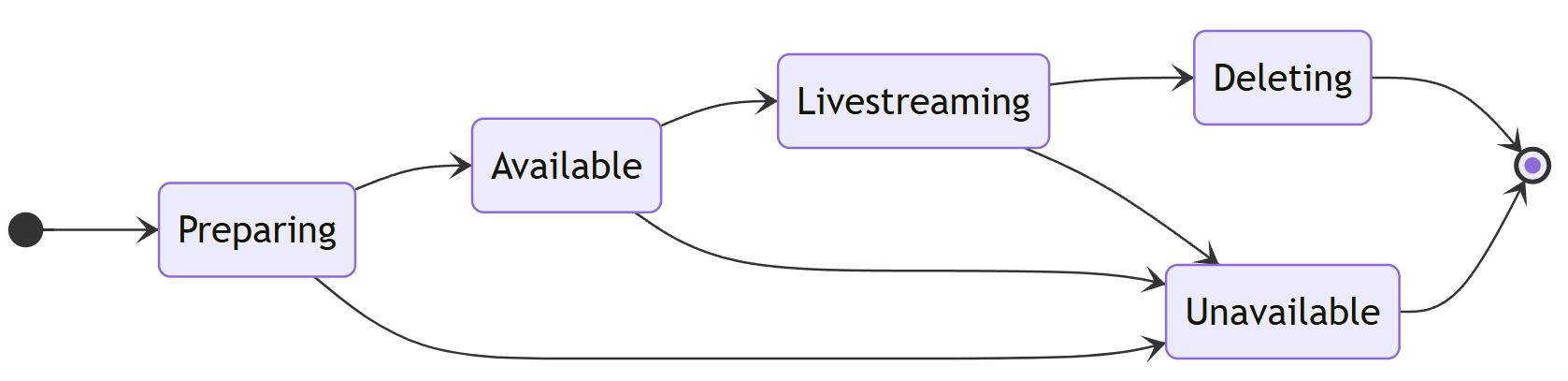

## ライフサイクル

LiveStreamingSession の状態の遷移と基本的な配信の流れについて説明します。

### 状態の遷移

LiveStreamingSession は以下の 5 種類の状態を持ちます。

- Preparing

- 配信の準備中です。最大で 10 分程度の待ち時間の後、自動的に Available に遷移します。

- Available

- 配信の準備が完了した状態です。startSession のリクエストが送られると、Livestreaming に遷移します。

- Livestreaming

- 配信中です。deleteSession のリクエストが送られると、Deleting に遷移します。

- Deleting

- 配信の削除中です。このプロセスが完了すると、LiveStreamingSession は自動的に削除されます。

- Unavailable

- 配信が利用できない状態です。回復不能なエラーが発生した場合に遷移します。getSession のリクエストを送ることでエラーの内容を確認できます。deleteSession のリクエストを送ることで LiveStreamingSession の削除を行います。

### 基本的な配信の流れ

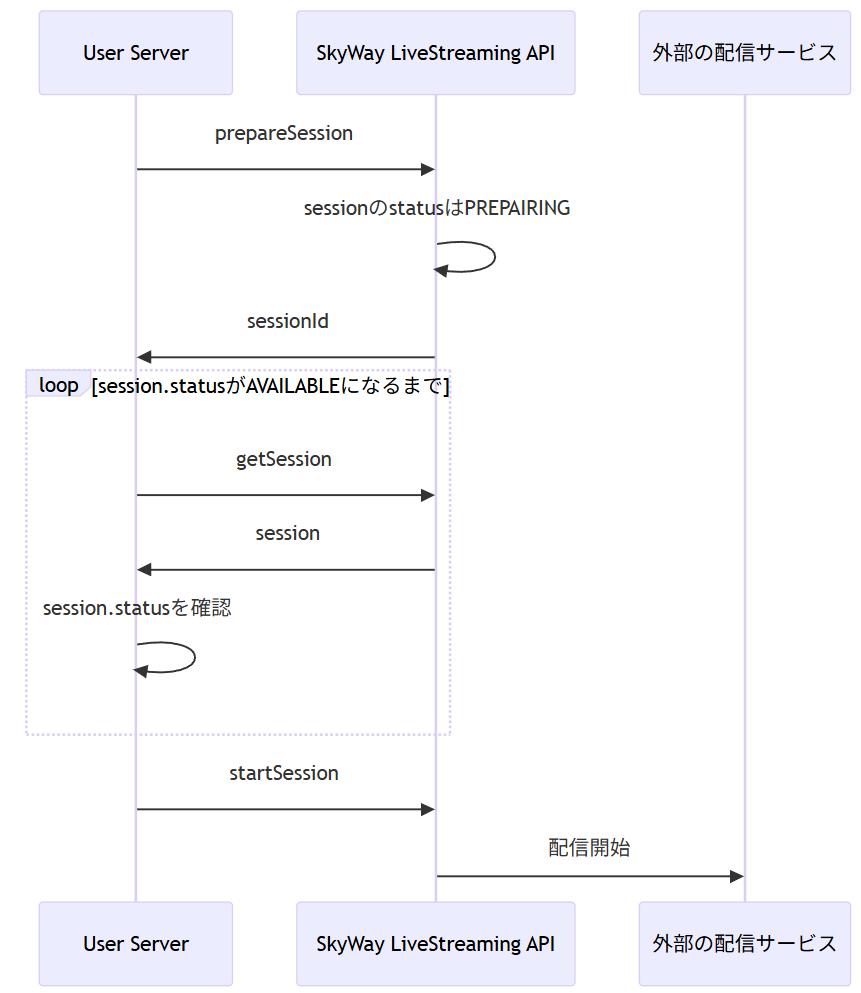

#### 配信の開始

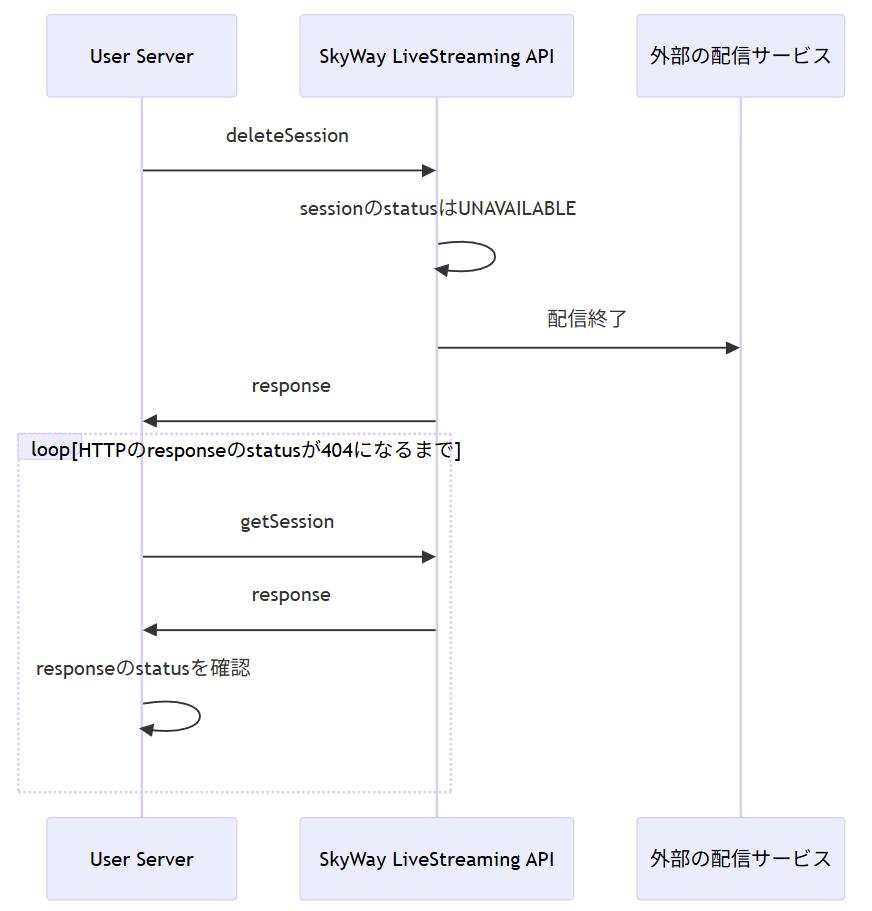

#### 配信の終了

---

## ユーザーガイド/配信 β版/クイックスタート

Path: user-guide_livestreaming_quickstart.md

# クイックスタート

本チュートリアルでは、SkyWay LiveStreaming API を利用して映像・音声を配信する方法を紹介します。

なお、SkyWay LiveStreaming API は現在オープンベータ版として提供しています。本機能のご利用をご希望の方は、[SkyWayお問い合わせ](https://support.skyway.ntt.com/hc/ja/requests/new?ticket_form_id=14615614124185)よりご連絡ください。SkyWay LiveStreaming API の Base URL をご案内いたします。

## 配信サービスの準備

### 動作確認済みの配信サービス

SkyWay LiveStreaming API では、以下の配信サービスで動作確認を行っています。

配信の開始には、ストリームキーが必要です。以下を参考に取得してください。

#### YouTube

- **今すぐライブ配信を開始する**

[YouTubeサポート記事](https://support.google.com/youtube/answer/2907883?hl=ja&ref_topic=9257984&sjid=10895521970513023508-AP#zippy=%2C%E4%BB%8A%E3%81%99%E3%81%90%E3%83%A9%E3%82%A4%E3%83%96%E9%85%8D%E4%BF%A1%E3%82%92%E9%96%8B%E5%A7%8B%E3%81%99%E3%82%8B)

#### Twitch

- **ストリームキー**

[Twitch Stream Keyに関するFAQ](https://help.twitch.tv/s/article/twitch-stream-key-faq?language=ja)

---

その他の配信サービスで配信を開始するには、配信 URL とストリームキーが必要です。配信サービスのドキュメントをご参照ください。

### 開発時に用いることができる配信サービス

開発中に YouTube や Twitch などのサービスを使わずに自前でテストを行いたい場合は、外部からアクセス可能なサーバー上に以下のような RTMP/HLS サーバーをデプロイして利用できます。

- [https://github.com/TareqAlqutami/rtmp-hls-server](https://github.com/TareqAlqutami/rtmp-hls-server)

- [https://github.com/illuspas/Node-Media-Server](https://github.com/illuspas/Node-Media-Server)

利用方法は、それぞれのリポジトリのドキュメントをご参照ください。これらのサービスはサポートの対象外となります。

最終的な動作確認は実際に配信を行う際に利用するサービスで実施してください。

---

## チュートリアルアプリの作成

ここからは JavaScript SDK と Node.js を用いて、映像・音声の配信機能を体験できるシンプルなアプリケーションを作成します。

最終的に、以下のような形で映像と音声をYouTubeなどに配信できます。

### 構成

本チュートリアルで作成するアプリケーションは、管理者が利用するサーバーサイドと、ブラウザで動作するクライアントサイドで構成されます。

- **サーバーサイド**

SkyWay のサーバーサイド API を制御し、トークンの管理などを担います。

- **クライアントサイド**

ブラウザで音声・ビデオ通話を行うアプリケーションを動かし、実際に会議や映像配信を行います。

また、管理者はサーバーの API に対して curl コマンドでリクエストを送信して、以下の操作を行います。

1. 配信の準備

2. 配信の開始

3. 配信設定の更新

4. 配信の終了

---

### 環境構築

1. **Node.js のインストール**

バージョン20以降をインストールしてください。

2. **ディレクトリ構成**

任意の作業ディレクトリに `tutorial` ディレクトリを作成し、 `tutorial` ディレクトリの中に以下の内容の `package.json` を配置します。

```json

{

"name": "tutorial",

"version": "1.0.0",

"main": "index.js",

"type": "module",

"scripts": {

"server": "node server/main.js",

"client": "parcel client/index.html --open"

},

"dependencies": {

"@skyway-sdk/room": "^2.0.0",

"@skyway-sdk/token": "^1.7.0",

"cors": "^2.8.5",

"express": "^4.21.2",

"jsrsasign": "^11.1.0"

},

"devDependencies": {

"@types/express": "^4.17.21",

"parcel": "^2.13.3"

}

}

```

3. **パッケージのインストール**

`package.json` を配置したディレクトリ内で、以下のコマンドを実行してください。

```bash

npm i

```

---

### サーバーサイド

SkyWay Live Streaming API を HTTP 経由で操作するため、Node.js のサーバーアプリケーションを作成します。

#### ソースファイルの作成

1. `tutorial` ディレクトリ内に `server` ディレクトリを作成し、`server` ディレクトリの中に以下の内容の `main.js` を配置します。

_tutorial/server/main.js_

```js

import { nowInSec, SkyWayAuthToken, uuidV4 } from "@skyway-sdk/token";

import cors from "cors";

import express from "express";

import jsrsasign from "jsrsasign";

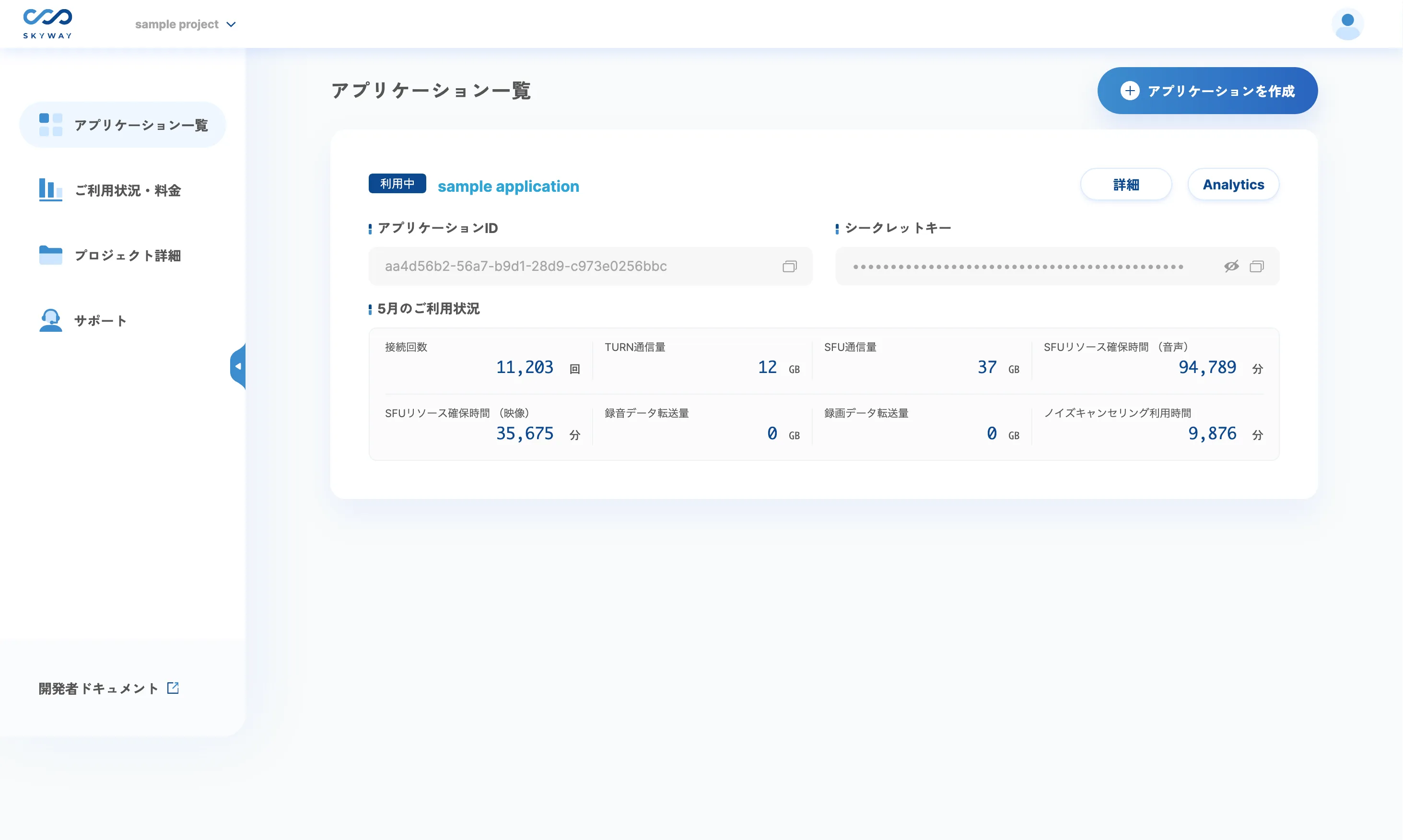

// SkyWayのアプリケーションIDとシークレットキー

const appId = "ここにアプリケーションIDをペーストしてください";

const secret = "ここにシークレットキーをペーストしてください";

// LiveStreaming APIのBase URLは、オープンベータ版のご利用申請後にご案内いたします

// お問い合わせ: https://support.skyway.ntt.com/hc/ja/requests/new?ticket_form_id=14615614124185

const livestreamingApiBaseUrl = "ここにLiveStreaming APIのBase URLを入力してください";

const channelApiUrl = "https://channel.skyway.ntt.com/v1/json-rpc";

// 配信サービスの設定

const output = {

type: "RTMP",

target: {

service:

"ここに「YOUTUBE」か「TWITCH」と入力するか、その他のサービスを利用する場合はRTMPのエンドポイントを入力してください",

streamKey: "ここに配信サービスのストリームキーをペーストしてください",

},

};

```

**補足:**

- `appId` と `secret` はご自身の SkyWay アプリケーションで発行されたアプリケーション ID・シークレットキーに置き換えてください。

- `service` : 動作を保証している YouTube と Twitch に関してはそれぞれのラベルである「YOUTUBE」と「TWITCH」を指定することで利用できます。その他のサービスは RTMP のエンドポイント(rtmp://で始まる)を指定してください

- `streamKey` : 配信先(YouTube, Twitch など)のストリームキーを指定してください。

---

#### SkyWay Admin Auth Token の作成

SkyWay の LiveStreaming API および Channel API を操作するためには、**SkyWay Admin Auth Token** を作成する必要があります。詳細は以下のドキュメントを参照してください。

- [SkyWay Admin Auth Token](/ja/docs/user-guide/authentication/skyway-admin-auth-token/)

SkyWay Admin Auth Token を作成するための `createSkyWayAdminAuthToken` 関数を `main.js` ファイルに追記します。

_tutorial/server/main.js_

```js

// Channel APIとLiveStreaming APIを操作するためのトークンを作成

const createSkyWayAdminAuthToken = () => {

const token = jsrsasign.KJUR.jws.JWS.sign(

"HS256",

JSON.stringify({ alg: "HS256", typ: "JWT" }),

JSON.stringify({

exp: nowInSec() + 60,

iat: nowInSec(),

jti: uuidV4(),

appId,

}),

secret

);

return token;

};

```

---

#### SkyWay Auth Token の作成

SkyWay のクライアントサイド SDK を利用するためには、**SkyWay Auth Token** が必要です。詳細は以下を参照してください。

- [SkyWay Auth Token](/ja/docs/user-guide/authentication/skyway-auth-token/)

SkyWay Auth Token を作成するための `createSkywayAuthToken` 関数を `main.js` ファイルに追記します。

_tutorial/server/main.js_

```js

// クライアント用のトークン

const createSkywayAuthToken = (channelId) => {

const token = new SkyWayAuthToken({

jti: uuidV4(),

iat: nowInSec(),

exp: nowInSec() + 60 * 60 * 24,

version: 3,

scope: {

appId,

rooms: [

{

id: channelId,

methods: [],

member: {

id: "*",

methods: ["publish", "subscribe", "updateMetadata"],

},

},

],

},

}).encode(secret);

return token;

};

```

---

#### Channelの作成

サーバー起動時に、一度だけ SkyWay の Channel を作成します。

下記のコードでは、`fetch` 関数を使い、Channel API の `createChannel` メソッドを呼び出して新しい Channel を作成しています。

SkyWay Channel API の詳細な仕様は以下の記事を参照してください。

- [SkyWay Channel API](/ja/docs/user-guide/channel-api/)

Channel API の `createChannel` メソッドを呼び出すコードを `main.js` に追記します。

_tutorial/server/main.js_

```js

// SkyWayのChannelを作成

const createChannelResponse = await fetch(channelApiUrl, {

method: "POST",

headers: {

"Content-Type": "application/json",

"Authorization": `Bearer ${createSkyWayAdminAuthToken()}`,

},

body: JSON.stringify({

jsonrpc: "2.0",

id: uuidV4(),

method: "createChannel",

params: {},

}),

});

if (!createChannelResponse.ok) {

console.error(await createChannelResponse.json());

throw new Error("Failed to create channel");

}

const {

result: {

channel: { id: channelId },

},

} = await createChannelResponse.json();

```

---

#### サーバーフレームワークの設定

チュートリアルアプリでは、HTTP サーバーを実行するためのフレームワークとして Express を利用します。

Express の設定を行うためのコードを `main.js` に追記します。

_tutorial/server/main.js_

```js

const app = express();

app.use(cors());

app.use(express.json());

```

---

#### メディア合成のプリセット設定

メディア合成の設定では、配信される映像と音声がどのような形式になるか定義できます。例えば参加者全員の映像を格子状に並べることや、ある特定の属性を持つ Member や Publication を選択して画面に表示すること等ができます。

このチュートリアルでは、以下 2 種類の合成レイアウトを定義します。

**1. Grid**

- 映像: 複数の参加者の映像を格子状に分割して表示します。

- 音声: 音量が大きい順に上位4名の音声を出力します。

**2. Picture In Picture (pip)**

プレゼンター(`presenter`)の属性を metadata に持つメンバーの映像をメイン画面に、カメラ映像を小窓に表示します。それ以外のメンバー(`audience`)の映像は表示しません。

- 映像: プレゼンターの画面共有映像とカメラ映像を合成して表示します。

- 音声: プレゼンターの音声を出力します。

---

メディア合成の詳細な仕様は以下の記事を参照してください

[合成のルール](/ja/docs/user-guide/livestreaming/composite)

また、メディア合成の結果の事前確認やレイアウト調整に合成結果プレビューツールを使うこともできます。使用方法については以下の記事を参照してください

[合成結果プレビューツール](/ja/docs/user-guide/livestreaming/previewer)

`grid` と `pip` のレイアウトの定義を `main.js` に追記します。

_tutorial/server/main.js_

```js

// 合成のプリセット設定

/**

Gridレイアウトでは、numVideoElementsを4に固定していますが、

roomに参加しているメンバーやPublicationの数を反映させて可変にすることも可能です。

**/

const grid = () => {

const canvasWidth = 1280;

const canvasHeight = 720;

// videoElementsの数 (Gridのセルの数)を指定する

// ここを適宜変更することで動的にセル数を変化させられます

const numVideoElements = 4;

// 列数: 要素数の平方根の切り上げ

const columns = Math.ceil(Math.sqrt(numVideoElements));

// 行数: 要素数 ÷ 列数の切り上げ

const rows = Math.ceil(numVideoElements / columns);

// Canvas サイズから計算する1セルあたりの幅・高さ

const cellWidth = Math.round(canvasWidth / columns);

const cellHeight = Math.round(canvasHeight / rows);

const videoElements = [...new Array(numVideoElements).keys()].map((i) => {

const row = Math.floor(i / columns);

const col = i % columns;

return {

publisher: {

id: "*",

query: {

sortBy: "AUDIO_LEVEL",

index: i,

},

},

x: col * cellWidth,

y: row * cellHeight,

width: cellWidth,

height: cellHeight,

};

});

// 音声は最大4つまで合成できるため、音量上位4つを設定

const audioElements = [...new Array(4).keys()].map((i) => ({

publisher: {

id: "*",

query: {

sortBy: "AUDIO_LEVEL",

index: i,

},

},

}));

const composite = {

mode: "CUSTOM",

videoConfig: {

canvasWidth,

canvasHeight,

elements: videoElements,

},

audioConfig: {

elements: audioElements,

},

};

return composite;

};

/**

Picture in Pictureのメイン画面と小窓には

memberのmetadataに"presenter"が指定されているmemberのうち

最も音量が大きいmemberが表示される。

メイン画面にはpublicationのmetadataに"screen"が入ったpublicationが表示され、

小窓には"camera"が入ったpublicationが表示される。

**/

const pip = {

mode: "CUSTOM",

options: {

// クライアントからmetadataによる合成対象の更新を行う際にtrueにする

handleUpdateMetadata: true,

},

videoConfig: {

canvasWidth: 1280,

canvasHeight: 720,

elements: [

{

publisher: {

metadata: "presenter",

query: {

sortBy: "AUDIO_LEVEL",

index: 0,

},

videoPublication: {

metadata: "screen",

},

},

x: 0,

y: 0,

width: 1280,

height: 720,

},

{

publisher: {

metadata: "presenter",

query: {

sortBy: "AUDIO_LEVEL",

index: 0,

},

videoPublication: {

metadata: "camera",

},

},

x: 960,

y: 540,

width: 320,

height: 180,

zIndex: 1,

},

],

},

audioConfig: {

elements: [

{

publisher: {

metadata: "presenter",

query: {

sortBy: "AUDIO_LEVEL",

index: 0,

},

},

},

],

},

};

```

---

#### ユーザーのChannelへの入室

クライアントからリクエストを受け取り、Channel への入室用トークンと ChannelID を返すエンドポイントの定義を `main.js` に追記します。

_tutorial/server/main.js_

```js

// ユーザーがChannelに入室するためのエンドポイント

app.post("/user/join", async (_, res) => {

// 入室できるchannelIdを制限したトークンを作成する

const token = createSkywayAuthToken(channelId);

res.send({ token, channelId });

});

```

---

#### 配信の準備

管理者が配信を行う前に、「配信の準備」をする必要があります。

この処理は最大で 10 分ほどかかる場合があるため、Chunked レスポンスで進捗を返すように実装します。

PrepareLiveStreamingSession API を呼び出し、`status` が `AVAILABLE` になるまで定期的に状態を確認する処理を `main.js` に追記します。

_tutorial/server/main.js_

```js

// 管理者が配信の準備をするエンドポイント

let liveStreamingSessionId = "";

app.post("/admin/prepare", async (_, res) => {

// prepare は最大で10分ほどかかる可能性があるため

// 逐次ステータスを "Chunked" レスポンスで返す。

// AVAILABLE と表示されたら準備完了。

const response = await fetch(

`${livestreamingApiBaseUrl}/channels/${channelId}/sessions/prepare`,

{

method: "POST",

headers: {

Authorization: `Bearer ${createSkyWayAdminAuthToken()}`,

},

}

);

if (!response.ok) {

console.error(await response.json());

res.status(500).send();

return;

}

const { id } = await response.json();

liveStreamingSessionId = id;

res.set({

"Content-Type": "text/plain",

"Transfer-Encoding": "chunked",

});

res.write(`sessionId:${liveStreamingSessionId}\n`);

for (;;) {

// LiveStreamingセッションのStatusを取得

const response = await fetch(

`${livestreamingApiBaseUrl}/channels/${channelId}/sessions/${liveStreamingSessionId}`,

{

headers: {

Authorization: `Bearer ${createSkyWayAdminAuthToken()}`,

},

method: "GET",

}

);

const { status } = await response.json();

res.write(`status:${status}\n`);

if (status === "AVAILABLE") {

break;

}

await new Promise((resolve) => setTimeout(resolve, 1000));

}

res.end();

});

```

---

#### 配信の開始

配信の準備が完了したら、管理者は配信を開始できます。

配信を開始するために、StartLiveStreamingSession API を呼び出す処理を `main.js` に追記します。

ここでは、デフォルトの合成設定を `grid` にし、リクエストの `preset` のパラメーターが `"pip"` の場合は `pip` レイアウトに切り替えています。

_tutorial/server/main.js_

```js

// 管理者が配信を開始するエンドポイント

app.post("/admin/start", async (req, res) => {

const { preset } = req.body;

let composite = grid();

if (preset === "pip") {

composite = pip;

}

const response = await fetch(

`${livestreamingApiBaseUrl}/channels/${channelId}/sessions/${liveStreamingSessionId}/start`,

{

method: "POST",

headers: {

"Content-Type": "application/json",

"Authorization": `Bearer ${createSkyWayAdminAuthToken()}`,

},

body: JSON.stringify({

composite,

output,

}),

}

);

if (!response.ok) {

console.error(await response.json());

res.status(500).send();

return;

}

res.send();

});

```

---

#### 配信の設定更新

配信中に、`grid` ↔ `pip` の切り替えなど、メディア合成の設定を更新できます。

メディア合成の設定を更新するために、UpdateLiveStreamingSession API を呼び出す処理を `main.js` に追記します。

```js

// 管理者が配信のメディア合成設定を変更するエンドポイント

app.post("/admin/update", async (req, res) => {

const { preset } = req.body;

let composite = grid();

if (preset === "pip") {

composite = pip;

}

// canvasWidthとcanvasHeightは更新できないパラメーターであるため、updateのパラメーターから削除する

delete composite.videoConfig.canvasWidth;

delete composite.videoConfig.canvasHeight;

const response = await fetch(

`${livestreamingApiBaseUrl}/channels/${channelId}/sessions/${liveStreamingSessionId}`,

{

method: "PATCH",

headers: {

"Content-Type": "application/json",

"Authorization": `Bearer ${createSkyWayAdminAuthToken()}`,

},

body: JSON.stringify({

composite,

output,

}),

}

);

if (!response.ok) {

console.error(await response.json());

res.status(500).send();

return;

}

res.send();

});

```

---

#### 配信の終了

管理者が配信を終了するためのエンドポイントです。

配信を終了するために、DeleteLiveStreamingSession API を呼び出す処理を `main.js` に追記します。

_tutorial/server/main.js_

```js

// 配信を終了するエンドポイント

app.post("/admin/delete", async (_, res) => {

const response = await fetch(

`${livestreamingApiBaseUrl}/channels/${channelId}/sessions/${liveStreamingSessionId}`,

{

method: "DELETE",

headers: {

Authorization: `Bearer ${createSkyWayAdminAuthToken()}`,

},

}

);

if (!response.ok) {

console.error(await response.json());

res.status(500).send();

return;

}

res.send();

});

```

---

#### サーバーの起動

最後に、ポート `9091` で HTTP サーバーを起動するためのコードを `main.js` に追記します。

```js

app.listen(9091);

console.log("Server is running on http://localhost:9091");

```

---

### クライアントサイド

`tutorial` ディレクトリ内に `client` ディレクトリを作成し、`client` ディレクトリの中に以下の内容の `index.html` を配置します。

_tutorial/client/index.html_

```html

SkyWay Tutorial

ID:

role: audience

```

次に、`client` ディレクトリの中に以下の内容の `main.js` を配置します。

_tutorial/client/main.js_

```js

import {

SkyWayContext,

SkyWayRoom,

SkyWayStreamFactory,

} from "@skyway-sdk/room";

(async () => {

const localMediaArea = document.getElementById("local-media-area");

const remoteMediaArea = document.getElementById("remote-media-area");

const myId = document.getElementById("my-id");

const joinButton = document.getElementById("join");

const publishCamera = document.getElementById("publish-camera");

const publishScreen = document.getElementById("publish-screen");

const becomePresenter = document.getElementById("become-presenter");

const becomeAudience = document.getElementById("become-audience");

const roleLabel = document.getElementById("role-label");

joinButton.onclick = async () => {

// サーバーからChannel IDとトークンを取得

const response = await fetch(`http://localhost:9091/user/join`, {

method: "POST",

});

const { token, channelId } = await response.json();

// SkyWayContextを作成し、既存のChannelに参加

const context = await SkyWayContext.Create(token);

const room = await SkyWayRoom.Find(context, { id: channelId }, { type: 'sfu' });

const me = await room.join();

myId.textContent = me.id;

// Presenter / Audience の切り替え

becomePresenter.onclick = async () => {

roleLabel.textContent = "role: presenter";

// LiveStreaming APIでは次のような構造のメタデータのlabelを参照することができます

await me.updateMetadata(

JSON.stringify({

SKYWAY_SYSTEM: {

liveStreaming: {

label: "presenter",

},

},

})

);

};

becomeAudience.onclick = async () => {

roleLabel.textContent = "role: audience";

await me.updateMetadata(

JSON.stringify({

SKYWAY_SYSTEM: {

liveStreaming: {

label: "audience",

},

},

})

);

};

// ストリームのPublishを行う関数

const publish = async (stream, label) => {

const publication = await me.publish(

stream,

label != undefined

? {

metadata: JSON.stringify({

SKYWAY_SYSTEM: {

liveStreaming: {

label,

},

},

}),

}

: undefined

);

// DOMに表示

const newMedia = document.createElement("div");

const labelElement = document.createElement("span");

newMedia.appendChild(labelElement);

labelElement.textContent = ` id:${publication.id} contentType:${publication.contentType} label:${label} `;

const unpublishButton = document.createElement("button");

newMedia.appendChild(unpublishButton);

unpublishButton.textContent = "Unpublish";

unpublishButton.onclick = async () => {

await me.unpublish(publication);

newMedia.remove();

};

localMediaArea.appendChild(newMedia);

};

// 音声ストリームをPublish

const audio = await SkyWayStreamFactory.createMicrophoneAudioStream();

await publish(audio);

// カメラ映像をPublish

publishCamera.onclick = async () => {

const video = await SkyWayStreamFactory.createCameraVideoStream();

await publish(video, "camera");

};

// 画面共有をPublish

publishScreen.onclick = async () => {

const { video } = await SkyWayStreamFactory.createDisplayStreams();

await publish(video, "screen");

};

// 他メンバーがPublishしたストリームをSubscribe

const subscribeAndAttach = async (publication) => {

// 自分がPublishしたストリームは除外

if (publication.publisher.id === me.id) return;

const { stream } = await me.subscribe(publication.id);

let newMedia;

switch (stream.track.kind) {

case "video":

newMedia = document.createElement("video");

newMedia.playsInline = true;

newMedia.autoplay = true;

break;

case "audio":

newMedia = document.createElement("audio");

newMedia.controls = true;

newMedia.autoplay = true;

break;

default:

return;

}

stream.attach(newMedia);

remoteMediaArea.appendChild(newMedia);

};

room.onStreamPublished.add((e) => subscribeAndAttach(e.publication));

await Promise.all(room.publications.map(subscribeAndAttach));

};

})().catch((e) => console.error("main error", e));

```

---

## チュートリアルアプリの実行

### 1. アプリケーションの起動

1. **サーバーの起動**

以下のコマンドでサーバーを起動します。`http://localhost:9091` でリクエストを待ち受けます。

```bash

npm run server

```

2. **クライアントの起動**

別のターミナルを開いて以下のコマンドを実行すると、ブラウザが自動的に起動します(またはターミナルに表示される URL を直接開きます)。

```bash

npm run client

```

### 2. クライアントサイドの操作

- **1. join ボタン**

サーバーから発行された Token と ChannelID を使って SkyWay の Channel に入室します。

- **2. publishCamera / publishScreen ボタン**

それぞれ、カメラ映像・画面共有映像を配信(Publish)します。

- **3. Become Presenter / Become Audience ボタン**

現在入室中のメンバーの `metadata` を切り替え、配信時のメディア合成設定に反映させます(`presenter` と `audience` の判定)。

---

### 管理者による配信のコントロール

管理者は次のエンドポイントを `curl` コマンドなどで呼び出すことで、配信を制御します。

### 1. 配信の準備

```bash

curl -X POST http://localhost:9091/admin/prepare

```

- コンソール出力でステータスが逐次表示され、`AVAILABLE` となったら配信可能です。

### 2. 配信の開始

```bash

curl -X POST http://localhost:9091/admin/start

```

- 配信開始時のレイアウトはデフォルトで `grid` が指定されます。

- レイアウトを指定する場合、以下のように `preset` を JSON で渡します。

```bash

curl -X POST -H "Content-Type: application/json" \

-d '{"preset":"pip"}' \

http://localhost:9091/admin/start

```

#### **pip レイアウト利用時の注意**

- 「presenter」役のメンバーがいない場合や映像の Publish が行われていない場合、何も表示されません。デモ時には必ず「Become Presenter」ボタンを押し、映像を Publish しているか確認してください。

### 3. 配信設定の更新

以下のように、`preset` に `pip` または `grid` を指定してレイアウトを切り替えます。

```bash

curl -X POST -H "Content-Type: application/json" \

-d '{"preset":"pip"}' \

http://localhost:9091/admin/update

```

### 4. 配信の終了

```bash

curl -X POST http://localhost:9091/admin/delete

```

- 配信を終了すると、LiveStreamingSession は削除されます。

- 再度配信を開始する場合は `prepare → start` のフローを改めて行ってください。

---

## トラブルシューティング

このクイックスタートでエラーが発生した場合は、エラーレスポンスを元に[開発ガイド](/ja/docs/user-guide/livestreaming/guide/)を参照してください。

---

## ユーザーガイド/配信 β版/合成のルール

Path: user-guide_livestreaming_composite.md

# 合成のルール

このドキュメントでは SkyWay LiveStreaming API で SkyWay の映像や音声を合成する設定のルールについて説明します。

JSON 形式の設定によって映像と音声の合成の制御が可能です。

指定可能なパラメーターの詳細は、[APIリファレンス](https://livestreaming.api-reference.skyway.ntt.com/api-reference/index.html)を参照してください。

合成の設定は Channel 中の Publication を選択し、どのようなレイアウトで表示するかを設定します。

LiveStreaming Service は合成の設定に従って Publication を合成した映像を配信サービスに配信します。

合成の設定は大きく3つに分かれています。

- mode

- 現在は CUSTOM モードのみ利用可能です

- videoConfig

- 映像の合成に関する設定を行います

- audioConfig

- 音声の合成に関する設定を行います

## 映像合成の設定

videoConfig では映像の合成について、以下の設定が可能です。

- 必須

- canvasWidth

- 出力映像の横幅のピクセル数

- canvasHeight

- 出力映像の縦幅のピクセル数

- elements

- 合成対象となる映像を設定します。指定方法は後述します。

- オプション

- backgroundImage

- 出力映像の背景画像

- png 形式の画像を base64化した文字列を入力する

- 背景画像は常に要素より奥に描画されます

## 音声合成の設定

videoConfig では音声の合成について、以下の設定が可能です。

- 必須

- elements

- 合成対象となる音声を設定します。指定方法は後述します。

## 要素の設定

要素とは、合成における個々の映像または音声の要素を指します。たとえば、会議中の参加者のカメラ映像や画面共有、個別の音声がそれに該当します。

### 映像の要素の設定

videoConfig 内の elements プロパティで、各映像の要素について以下の設定が可能です。

- 必須

- publisher

- 合成対象となる Publication を選択します。選択方法は後述します。

- width

- 要素の横幅のピクセル数

- height

- 要素の縦幅のピクセル数

- x

- 要素の X 座標

- 左側が原点

- y

- 要素の Y 座標

- 上側が原点

- オプション

- zIndex

- 要素の重なりの順の指定

- 0以上255以下の値を指定できます

- 0が最も奥です

- 背景画像は要素の zIndex の値にかかわらず常にエレメントより奥に描画されます

- デフォルトで0が割り当てられます

映像の要素は49個まで設定できます。

次のように x を30,y を60と設定した場合はこのような出力となります。

```json

{

"mode": "CUSTOM",

"videoConfig": {

"canvasWidth": 720,

"canvasHeight": 720,

"elements": [

{

"publisher": {

"id": "*"

},

"height": 300,

"width": 300,

"x": 30,

"y": 60

}

]

},

"audioConfig": {

"elements": []

}

}

```

### 音声の要素の設定

audioConfig 内の elements プロパティで、各音声の要素について以下の設定が可能です。

- 必須

- publisher

- 合成対象となる Publication を選択します。選択方法は後述します。

音声の要素は4個まで設定できます。

### 要素のPublicationの選択

各要素では、publisher プロパティを使用して合成対象となる Publication の選択をする必要があります。選択の手順は以下のような流れになります。

1. publisher の選択

この時点で選択した Publisher のすべての Publication が候補になります。

2. query による絞り込み

1で選択した候補から最終的に1つの Publisher を選択します。

3. publisher の publication を選択

2で選択した Publisher が publish している Publication を候補として Publication を選択します。この時点で複数の候補が存在する可能性があります。

4. 対象の Publication の決定

3で選択した候補から最終的に1つの Publication を選択します。

#### publisherの選択

以下の識別子から Publisher(Publication を Publish した Member)を選択できます。

(※core ライブラリを利用している場合は SFU-Bot ではなく元の Publication を Publish している Person が対象です。)

- id

- name

- metadata

いずれの識別子も選択されていない場合は channel 中のすべての Member が候補となります

#### queryによる候補の絞り込み

publisher の選択の結果、複数の Publisher の候補が存在する場合、query プロパティによって1つに絞り込みます。

query では以下の設定が可能です。

- sortBy

- Publisher の候補をリアルタイムに、どのような順序で並べるかを指定できます

- AUDIO_LEVEL

- 各 Publisher の Publish している AudioPublication のうち、最も音量が大きい AudionPublication の音量が大きい順

- TIMELINE

- Publisher が Room に Join した時刻順

- index

- ソートされた Publisher の候補の配列から最終的な Publisher を選択するための添字

- -1を指定すると候補の配列の最後の Publisher が選択される

query を指定しない場合はデフォルトで sortBy が TIMELINE、index が0に設定されます。

**例**

Channel 中の AUDIO_LEVEL 上位2 publisher の publication を選択して描画する設定と結果は次のようになります。

```json

{

"mode": "CUSTOM",

"videoConfig": {

"canvasWidth": 1920,

"canvasHeight": 1080,

"elements": [

{

"publisher": {

"id": "*",

"query": {

"sortBy": "AUDIO_LEVEL",

"index": 0

}

},

"x": 0,

"y": 0,

"width": 960,

"height": 1080

},

{

"publisher": {

"id": "*",

"query": {

"sortBy": "AUDIO_LEVEL",

"index": 1

}

},

"x": 960,

"y": 0,

"width": 960,

"height": 1080

}

]

},

"audioConfig": {

"elements": [

{

"publisher": {

"id": "*",

"query": {

"sortBy": "AUDIO_LEVEL",

"index": 0

}

}

},

{

"publisher": {

"id": "*",

"query": {

"sortBy": "AUDIO_LEVEL",

"index": 1

}

}

}

]

}

}

```

---

#### publicationの選択

audioPublication または videoPublication プロパティでは以下の識別子から Publisher の Publication を選択できます。

- id

- metadata

選択できる Publication は config の種類と同じものに限られます。(audioConfig なら contentType が Audio のもの、videoConfig なら contentType が Video のもの)

publication プロパティを設定しない場合は最初に Publish された Publication が選択されます。

publication プロパティを設定した上で Publication の候補が複数ある場合は、より早く Publish された Publication が選択されます。

### 識別子の指定方法

id, name, metadata といった識別子は以下の方法で指定できます。

- id

- 対象のリソースに設定されている文字列(完全一致)、`*`(ワイルドカード)

- name

- 対象のリソースに設定されている文字列(完全一致)、`*` を含む文字列(部分一致)、 `*`(ワイルドカード)

- metadata

- 対象のリソースに設定されている文字列(完全一致)、`*` を含む文字列(部分一致)、 `*`(ワイルドカード)

name や metadata では、`audience-*` のような書き方をすることで部分一致で判定できます。

また name や metadata に `*` を指定した場合はその要素を持たない場合も含みます。

metadata を指定する場合は channel 中の member と publication の metadata に以下のフォーマットのデータを JSON 文字列の形式で格納してください。`SKYWAY_SYSTEM.liveStreaming.label` の内容と `metadata` に指定した識別子の内容でマッチングを行うことができます。

```json

{

"SKYWAY_SYSTEM": {

"liveStreaming": {

"label": ""

}

}

}

```

識別子で指定可能な文字種は、Channel、Member の name として使用可能な文字種、およびワイルドカードのみとなります。

[Channel、Memberのnameとして使用可能な文字種](/ja/docs/user-guide/commons/quotas-and-limits/#63)

## 設定の例

ここでは以下の3種類の合成例を説明します。

- side by side(横並びの映像)

- picture in picture(プレゼン用等の表示)

- Grid(全映像の表示)

### side by side

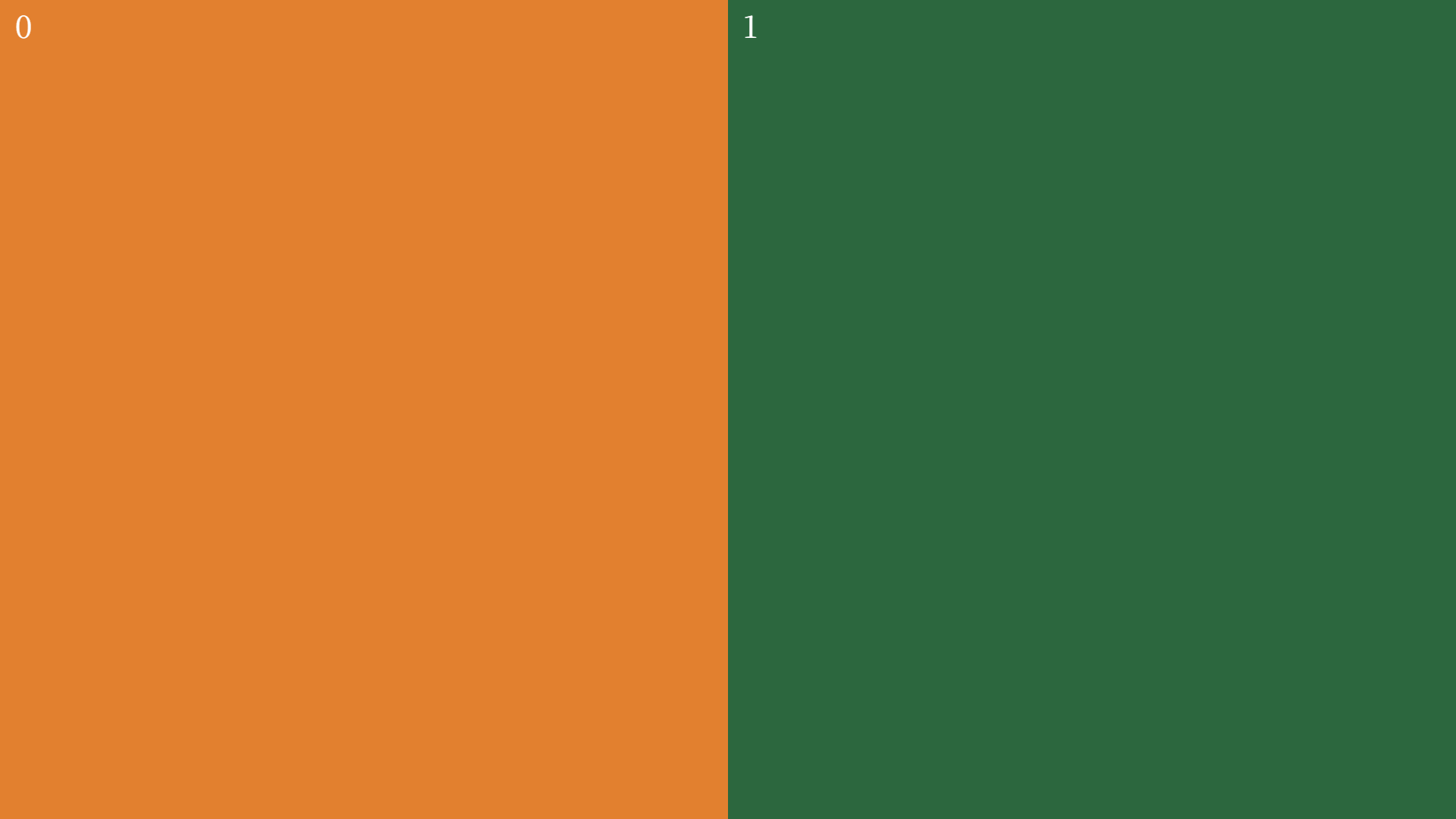

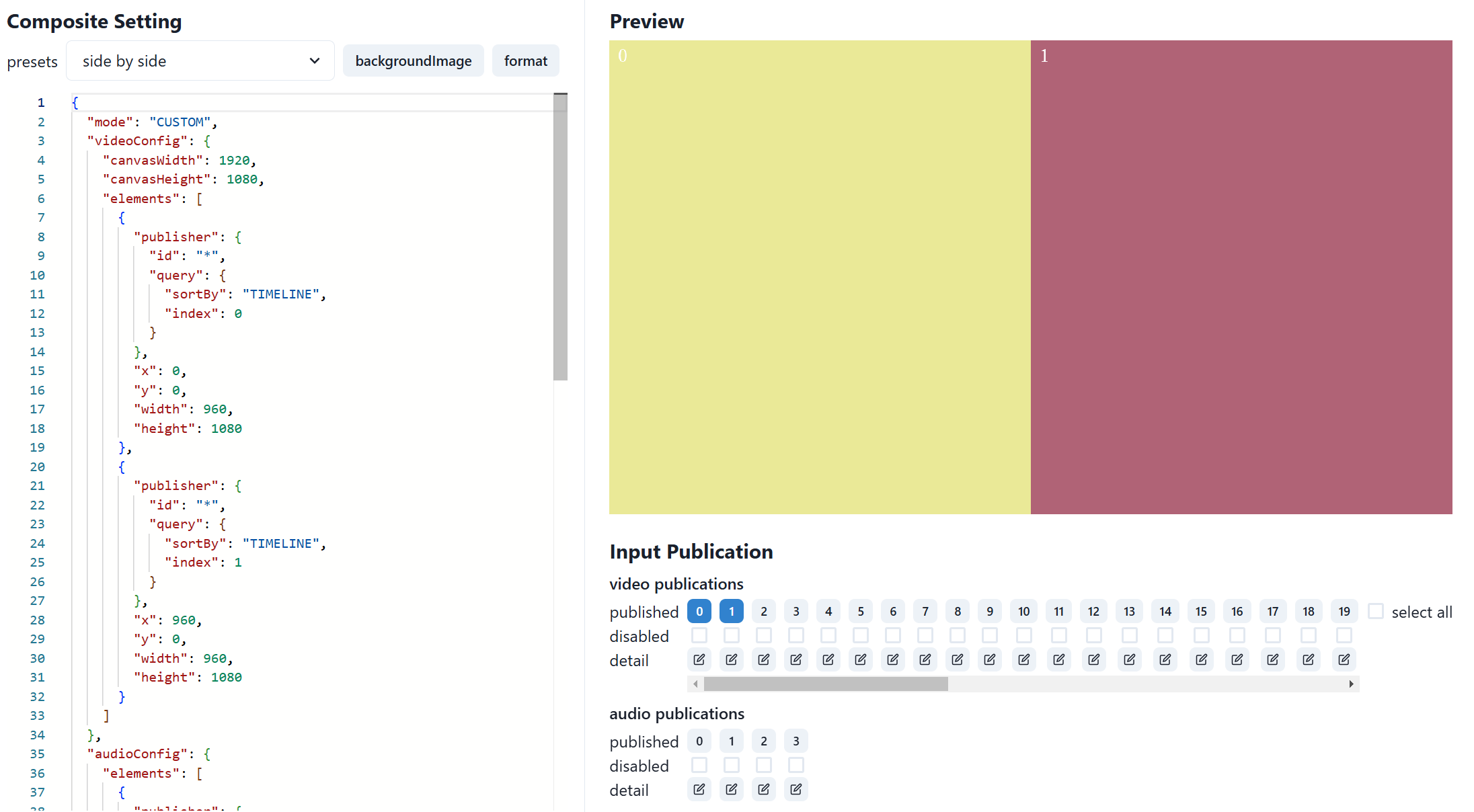

以下のスクリーンショットのような合成を行うための設定について説明します。

```json

{

"mode": "CUSTOM",

"videoConfig": {

"canvasWidth": 1920,

"canvasHeight": 1080,

"elements": [

{

"publisher": {

"id": "*",

"query": {

"sortBy": "TIMELINE",

"index": 0

}

},

"x": 0,

"y": 0,

"width": 960,

"height": 1080

},

{

"publisher": {

"id": "*",

"query": {

"sortBy": "TIMELINE",

"index": 1

}

},

"x": 960,

"y": 0,

"width": 960,

"height": 1080

}

]

},

"audioConfig": {

"elements": [

{

"publisher": {

"id": "*",

"query": {

"sortBy": "AUDIO_LEVEL",

"index": 0

}

}

},

{

"publisher": {

"id": "*",

"query": {

"sortBy": "AUDIO_LEVEL",

"index": 1

}

}

}

]

}

}

```

この例では、話者の音量が大きい上位2名の映像を画面の左と右に表示し、それらの音声を合成して出力しています。

### picture in picture

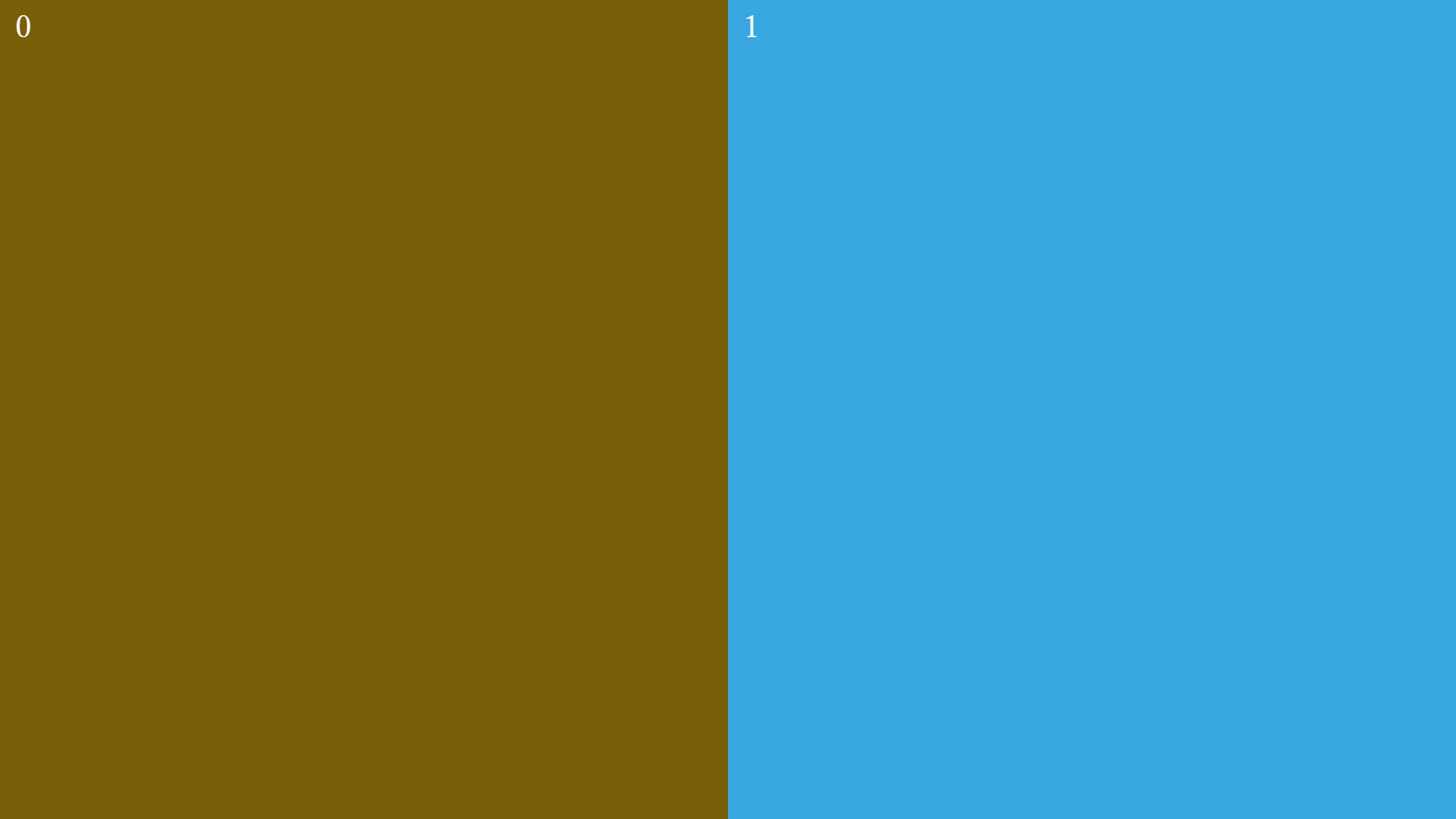

以下のスクリーンショットのような合成を行うための設定について説明します。

```json

{

"mode": "CUSTOM",

"videoConfig": {

"canvasWidth": 1280,

"canvasHeight": 720,

"elements": [

{

"publisher": {

"id": "*",

"query": {

"sortBy": "TIMELINE",

"index": 0

}

},

"x": 0,

"y": 0,

"width": 1280,

"height": 720,

"zIndex": 0

},

{

"publisher": {

"id": "*",

"query": {

"sortBy": "TIMELINE",

"index": 1

}

},

"x": 960,

"y": 540,

"width": 320,

"height": 180,

"zIndex": 1

}

]

},

"audioConfig": {

"elements": [

{

"publisher": {

"id": "*",

"query": {

"sortBy": "AUDIO_LEVEL",

"index": 0

}

}

},

{

"publisher": {

"id": "*",

"query": {

"sortBy": "AUDIO_LEVEL",

"index": 1

}

}

}

]

}

}

```

この例では `screen-share` という label を metadata に持った映像を全画面に表示し、 `camera` という label を metadata に持った映像を小窓に表示しています。またそれらと同じ label を metadata に持った音声を合成して出力しています。

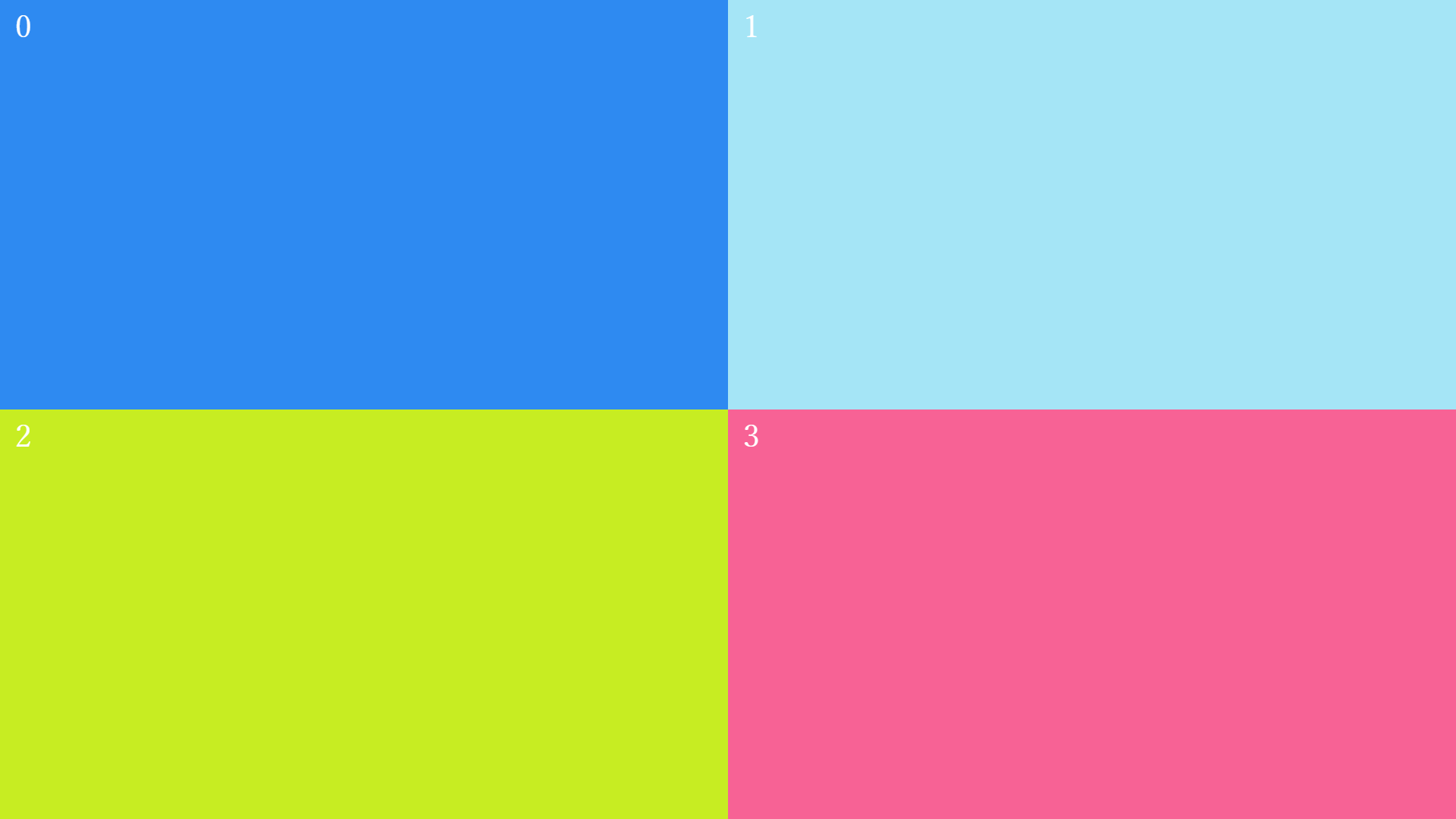

### Grid

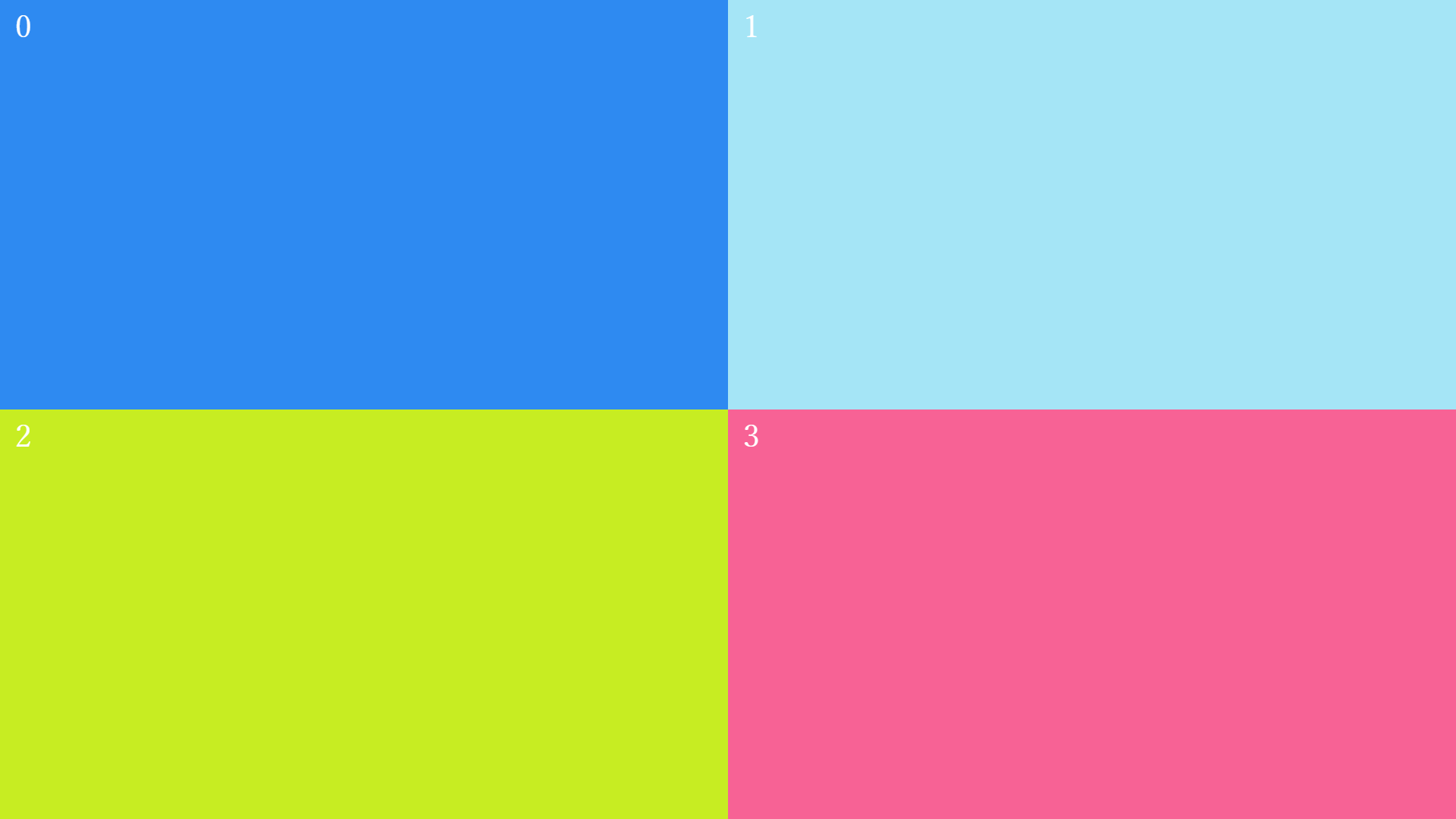

以下のスクリーンショットのような合成を行うための設定を JavaScript のプログラムで作成する例について説明します。

```js

const canvasWidth = 1280;

const canvasHeight = 720;

// elementsの数を指定する

const numElements = 9;

// 列数: 要素数の平方根の切り上げ

const columns = Math.ceil(Math.sqrt(numElements));

// 行数: 要素数 ÷ 列数の切り上げ

const rows = Math.ceil(numElements / columns);

// Canvas サイズから計算する1セルあたりの幅・高さ

const cellWidth = Math.floor(canvasWidth / columns);

const cellHeight = Math.floor(canvasHeight / rows);

const videoElements = [...new Array(numElements).keys()].map((i) => {

const row = Math.floor(i / columns);

const col = i % columns;

return {

publisher: {

id: "*",

query: {

sortBy: "TIMELINE",

index: i,

},

},

x: col * cellWidth,

y: row * cellHeight,

width: cellWidth,

height: cellHeight,

};

});

// 音声は最大4つまで合成できるので音量上位4つを設定する

const audioElements = [...new Array(4).keys()].map((i) => ({

publisher: {

id: "*",

query: {

sortBy: "AUDIO_LEVEL",

index: i,

},

},

}));

const composite = {

mode: "CUSTOM",

videoConfig: {

canvasWidth,

canvasHeight,

elements: videoElements,

},

audioConfig: {

elements: audioElements,

},

};

```

この例では指定した element の数に合わせてレスポンシブに映像を Grid 状に合成します。

---

## ユーザーガイド/配信 β版/開発ガイド

Path: user-guide_livestreaming_guide.md

# 開発ガイド

## 想定されるエラー

SkyWay LiveStreaming API を利用する際に発生する可能性のあるエラーについて説明します。

### **SkyWay LiveStreaming API のエラーレスポンス**

### **400**

正しくないリクエストであることを示します。以下の原因が考えられます。

1. パラメータの問題

リクエストに含まれるパラメータに問題があります。ドキュメントを参照して正しい値をパラメータに入れるように修正してください。

2. LiveStreamingSession の状態

状態遷移が正しくありません。

詳細については[ライフサイクルの説明](/ja/docs/user-guide/livestreaming/overview/#59)を参照してください。

### **401**

有効な SkyWay Admin Auth Token が使用されていません。[**SkyWay Admin Auth Token のドキュメント**](/ja/docs/user-guide/authentication/skyway-admin-auth-token/)を参照して正しいトークンを使用してください。

### **403**

リクエストが拒否されたことを示します。以下の原因が考えられます

1. 権限不足

外部の配信サービスの認証情報が不正な可能性があります。正しい認証情報を指定してください。

2. リソースの割り当て不足

割り当てられたリソースが上限に達している可能性があります。[**リソースの割り当て**](/ja/docs/user-guide/commons/quotas-and-limits/#7)の項目に記載されている範囲内で利用してください。

### **404**

対象のリソースが存在しません。

### **429**

レートリミットの制限を超えた数のリクエストが送られています。[**リクエストレートの制限**](/ja/docs/user-guide/commons/quotas-and-limits/#47)の項目に記載されている範囲内で利用してください。

### **500**

LiveStreaming サーバーにおいてエラーが発生しています。リクエストの処理が完了していない可能性があるため、リクエストを再試行してください。 複数回再試行を行なってもエラーが解消しない場合は、SkyWay のサポートに問い合わせてください。

### **503**

利用可能になるまで時間がかかることを示します。以下の原因が考えられます

1. 準備中

LiveStreamingSession の準備中です。完了に数分かかります。

2. 解放処理中

割り当てられたリソースが上限に達していますが、リソースの解放処理が進行中です。

リソースの解放が完了するまで時間がかかるので数分時間を空けるとリトライを再試行できます。

---

## ユーザーガイド/配信 β版/合成結果プレビューツール

Path: user-guide_livestreaming_previewer.md

## 1. アプリケーション概要

本アプリケーションは、**複数の映像や音声ストリームをサーバー側でひとつに合成**する際の設定や結果を、**ローカル環境でシミュレーションできるツール**です。

サーバー上で最終的に行う合成の事前確認やレイアウト調整を行うことを目的としています。(音声は出力されません)

最終的に確定した合成の設定は、LiveStreaming API に渡して映像・音声合成に利用できます。

- **リンク**

- [https://livestreaming.api-reference.skyway.ntt.com/apps/mcu-previewer/index.html](https://livestreaming.api-reference.skyway.ntt.com/apps/mcu-previewer/index.html)

本ツールでは、以下のような操作を行います。

1. **合成の設定(Composite Setting)の編集**

2. **入力される映像・音声(Publication)のオン/オフ・パラメータ管理**

3. **最終的なレイアウト・プレビューの確認**

---

## 2. 画面構成

画面は大きく次の2つのエリアに分かれています。

1. **左側:Composite Setting(JSONエディター)**

2. **右側:Input Publication の管理とプレビュー**

### 2.1. 左側:Composite Setting

- **目的**

サーバー側で合成するための設定を直接編集します。ここで編集した内容がプレビューやサーバーの合成結果に反映されます。

- **操作方法**

1. **プリセット設定(presets)**

- エディター上部にある「presets」ドロップダウンから、あらかじめ用意された合成の設定(例:`side by side` など)を選択できます。

- プリセットを選択すると、その設定がテキストエリアに反映されます。

- プリセットを自由に編集して、お好みの配置に調整することも可能です。

2. **背景画像の設定(backgroundImage)**

- `backgroundImage` ボタンから画像ファイルを指定すると、テキストエリア内の合成設定に背景画像の設定が追加されます。

- テキストエリアへ PNG 画像の Base64 文字列を直接指定することもできます。

- 背景画像を使用しない場合は省略可能です。

3. **JSONエディターでの編集**

- テキストエリア内に表示されている合成設定を直接編集できます。

- 合成ルールの詳細については、[合成のルールのドキュメント](/ja/docs/user-guide/livestreaming/composite)をご参照ください

- 編集内容は常時プレビューに反映されます。

4. **format ボタン**

- 画面下部の「**format**」ボタンをクリックすると、エディター内の JSON を整形できます。

5. **エラー時の挙動**

- JSON の記述に誤り(シンタックスエラーなど)がある場合、プレビューは反映されません。

- エラーメッセージが表示された場合は、内容を確認して原因を特定してください。

---

### 2.2. Input Publication

右側エリアの下部には、**映像・音声の入力(Publication)を管理**するためのリストが表示されています。

- **各 Publication の操作**

- **published**: 0から49の数字が割り当てられたボタンをクリックするとボタンの色が反転し Channel に Publish されているものとして扱われ、合成対象に含まれます。

- **disabled**: チェックを入れると Publication の state パラメータが disabled になり、合成対象には含まれるが映像・音声はオフ(出力されない)状態になります。

- **detail**: パラメータ編集用のモーダルウィンドウを開きます(後述「2.4. detail 編集画面」参照)。

### 2.3. Preview

右側エリアの上部では、**合成結果の見た目を確認するプレビュー画面**が表示されます。

- 左側の JSON エディターで編集した合成設定を元に、Input Publication の設定内容がリアルタイムに合成され、反映されます。

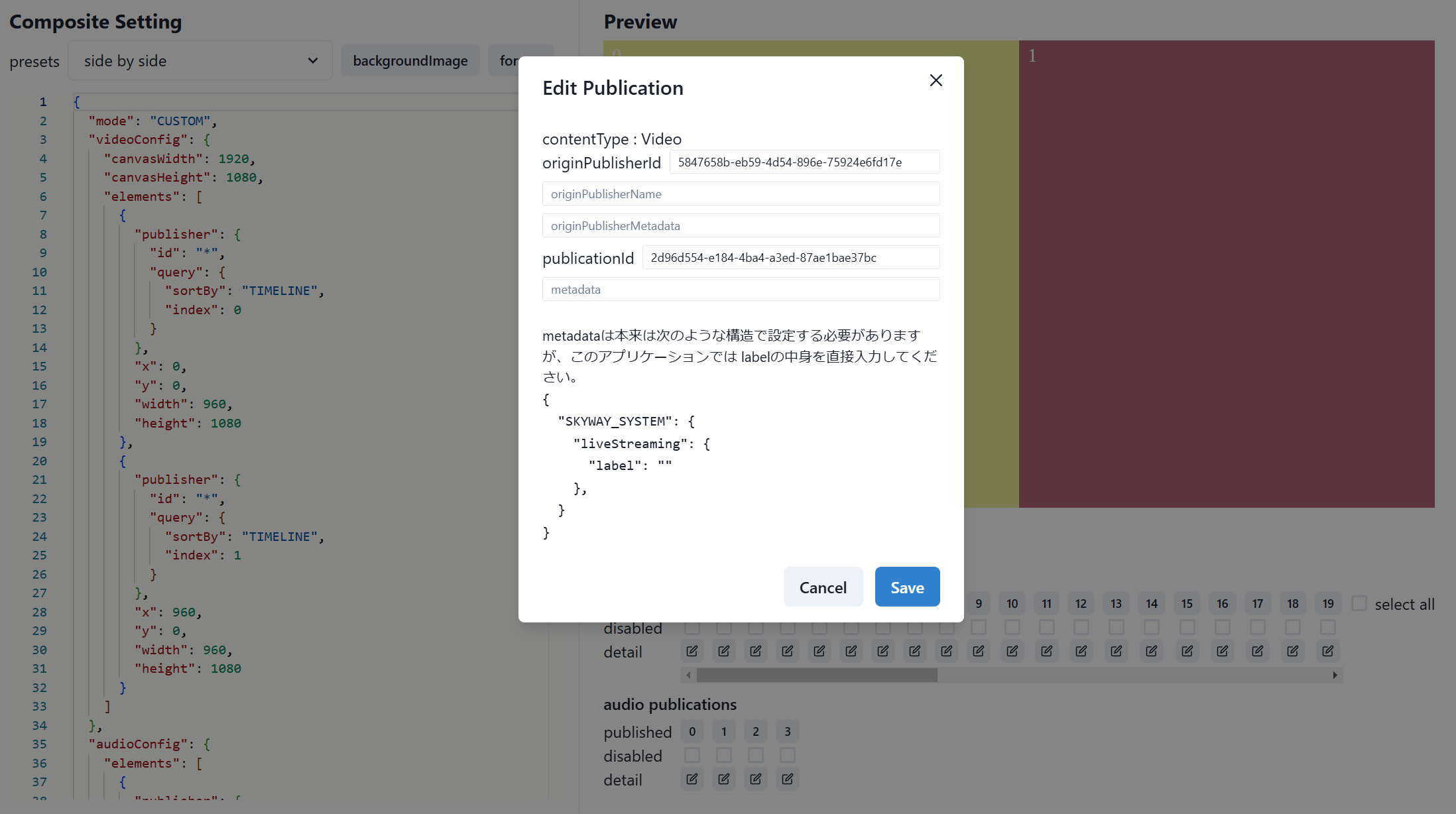

### 2.4. detail 編集画面(モーダルウィンドウ)

「detail」ボタンをクリックすると、対象の Publication に紐づくパラメータを編集する**モーダルウィンドウ**が表示されます。

以下のような項目を必要に応じて編集し、「Save」ボタンで確定します。

- **contentType**: メディアの種類(例: `Video`, `Audio`)

- **originPublisherId**: 映像・音声を Publish した Person の ID

- **originPublisherName**: 映像・音声を Publish した Person の Name

- **originPublisherMetadata**: 映像・音声を Publish した Person の Metadata

- **publicationId**: Publication の ID

- **metadata**: Publication の Metadata

---

## 3. 基本的な操作の流れ

以下は、ツールを使って合成設定を作成・調整する際のおおまかな手順です。

### 3.1. Composite Setting の編集

1. **プリセット選択**: presets から用途に近い合成設定を選択する(ゼロから作る場合は `plain` など)。

2. **JSON 編集**: 左側のテキストエリアで合成の設定を編集する。

3. **format ボタン**: 必要に応じて JSON を整形する。

### 3.2. Input Publication の設定

1. 右側の「Input Publication」一覧で合成対象に含めたい映像・音声の Publication にて **"published"** ボタンをクリックする。

2. 一時的に映像・音声をオフにしたい場合は **disabled** にチェックを入れて出力をオフにする。

3. さらに詳細を設定したい場合は「detail」ボタンでモーダルを開き、各種パラメータを編集して「Save」。

### 3.3. プレビューの確認

- 右側の「Preview」で、設定したレイアウトで合成した際の画面イメージを確認。

- Input Publication のオン/オフ変更や、detail モーダルでのパラメータ変更が想定通り反映されているかチェックする。

### 3.4. 合成設定の確定・API への連携

- 合成の設定が固まったら、テキストエリアの JSON をコピーして **LiveStreaming API** で利用できます。

- 実際の合成結果はライブストリーミングサービスの配信画面などでご確認ください。

---

## ユーザーガイド/SkyWay コンソール/概要

Path: user-guide_console-site_overview.md

# 概要

SkyWay コンソールは、プロジェクトとそれに紐づくアプリケーションを一元管理し、SDK 利用に必要なシークレットキーの発行や利用状況の確認を行えます。

本章では、ログイン後の画面構成と操作のポイントを解説します。

## 画面構成

### ヘッダーメニュー(画面上部)

- **プロジェクト切り替え**:

画面上部で操作対象のプロジェクトを選択・変更できます。

- **ユーザーメニュー**:

画面右上のアイコンからプロフィール編集やログアウトが可能です。

### サイドバー(左メニュー)

- **アプリケーション一覧**:

作成したアプリケーションを一覧表示します。

- **ご利用状況・料金**:

月次の通信量や課金額をグラフ・表で確認できます。

フリープランをご利用の場合、「ご利用状況」とのみ表示されます。

- **プロジェクト詳細**:

プロジェクトの設定やメンバー管理、契約情報の確認ができます。

- **サポート**:

問い合わせやテクニカルサポート窓口へのリンクを提供します。

---

## 新規プロジェクト作成方法

- 画面上部のプロジェクト切り替えメニューから **「プロジェクトを作成」** を選択します。

- プロジェクト名を入力し、作成をクリックします。

- プロジェクト名は後から変更可能です。

> ※ 新規に作成されるプロジェクトは、Free プラン(無料版)で開始されます。

---

## アプリケーション一覧画面

各アプリケーションは以下の情報を含むカードで表示されます。

| 項目 | 説明 |

|----------------|------------------------|

| **アプリ名** | サービスや用途に応じて付与した識別用の名称 |

| **アプリケーションID** | UUID 形式の一意キー |

| **シークレットキー** | SkyWay の利用に必要なシークレットキー |

| **ご利用状況(当月)** | アプリケーションごとの利用料を表示 |

| **詳細** | アプリケーション詳細画面へ移動 |

| **Analytics** | Analytics ダッシュボードへ移動 |

---

## 新規アプリケーション作成手順

- 画面右上の **「アプリケーションを作成」** ボタンをクリック

- 任意のアプリケーション名を入力し、作成をクリック

- アプリケーション名は後から変更可能です。

- 作成後に表示される **アプリケーションID** と **シークレットキー** をコピーし、SDK で利用します。

> ※ アプリケーションは 1 つのプロジェクトにつき最大 100 件まで作成可能です。

---

### 注意事項

- **シークレットキーの保管**:

第三者に漏洩しないよう、安全に管理してください。不正利用のリスクがあります。

- **権限管理**:

プロジェクトメンバーへは、ロールに応じた閲覧・編集権限を付与できます。

- 詳細はこちらをご覧ください:[プロジェクト詳細](./user-guide/console-site/project-detail)

- **Analytics**:

接続状況や通信状況など、詳細な分析には Analytics をご活用ください。

- 詳細はこちらをご覧ください:[Analytics 概要](./user-guide/analytics/overview)

---

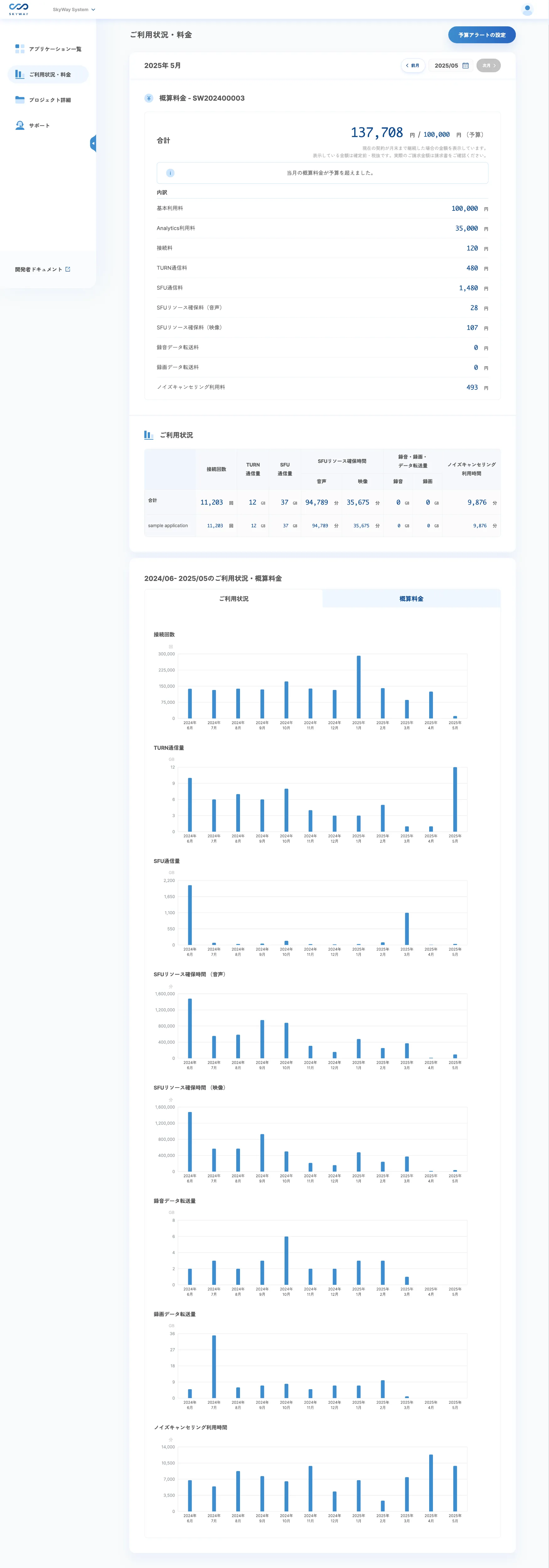

## ユーザーガイド/SkyWay コンソール/ご利用状況・料金

Path: user-guide_console-site_usage.md

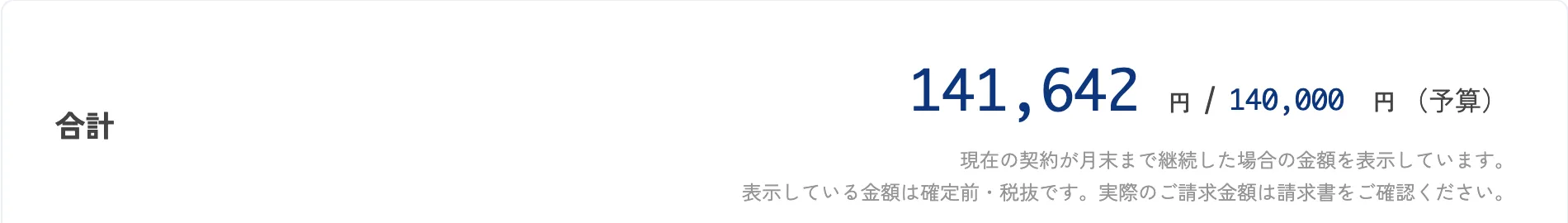

## ご利用状況・料金

プロジェクトの利用量および料金を確認できる画面です。

Free プランでは料金は発生しないため、利用量のみが表示されます。

Enterprise プランでは利用量に加えて、概算料金も確認できます。

---

### 画面構成

左上に「概算料金 – SW20xxxxxx 」が表示されます。

SW20xxxxxx はご契約ごとに発行される契約IDです。

Enterprise プランのみ右上に当月の概算料金が表示されます。

> ※表示される金額はあくまで概算です。実際の請求額は請求書をご確認ください。

---

### 概算料金セクション

概算料金セクションでは、当月の概算料金を内訳ごとに表示します。

概算料金セクションは Enterprise プランでのみ表示されます。

- 詳細な料金体系は、[料金ページ](https://skyway.ntt.com/ja/pricing/) をご参照ください。

---

### ご利用状況

**接続回数/TURN・SFU通信量/稼働時間/SFU リソース確保時間/録音・録画・データ転送量/ノイズキャンセリング利用時間** を表形式で表示します。

---

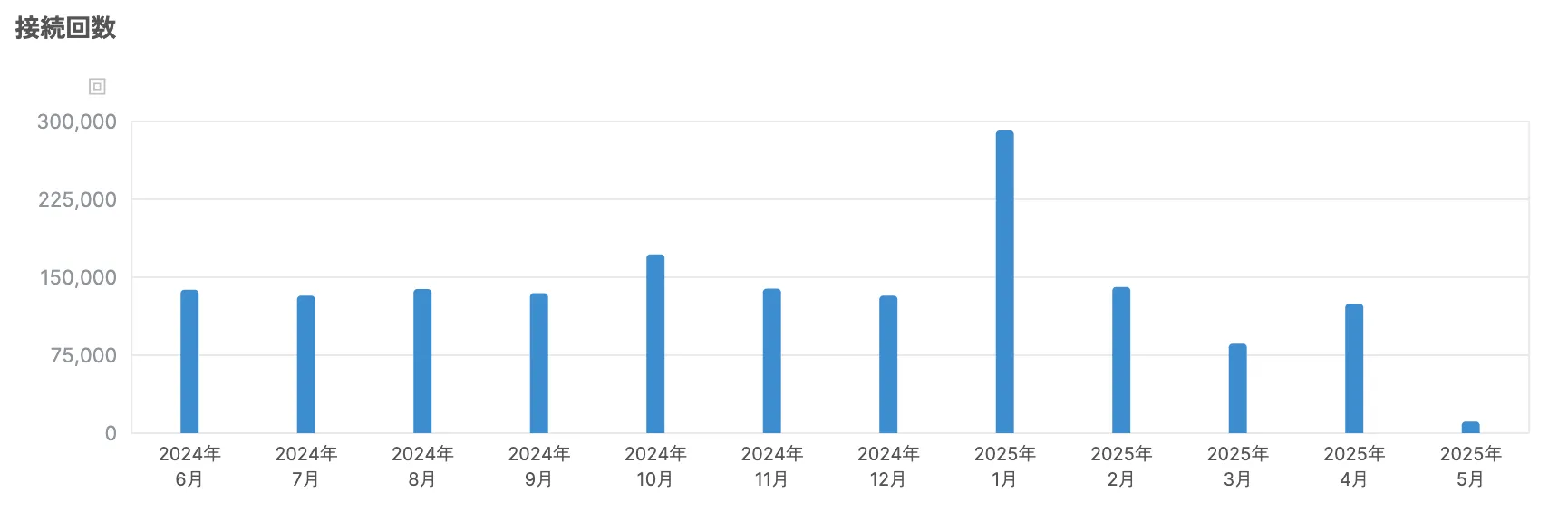

### 推移グラフ

「ご利用状況」同様の過去 12 か月のトレンドを棒グラフで表示。

- 接続回数

- TURN 通信量

- SFU 通信量・リソース確保時間

- 録音・録画データ転送量

- ノイズキャンセリング利用時間

## 予算アラート機能

Enterprise プランで利用できる「予算アラート」は、月次の概算料金が事前に設定した予算額に達した際に、プロジェクトオーナーおよび管理者にメール通知を行う機能です。

予算アラートの設定は、プロジェクトオーナーおよび管理者のみが行えます。

---

### アラート設定の流れ

- 画面右上の **「予算アラートの設定」** ボタンをクリック

- モーダルが開くので、以下を入力・選択

- **予算**:アラートを発報するしきい値(金額/円)

- **「設定」** をクリックして保存

- **「削除」**:既存アラートを削除

- **「キャンセル」**:変更を破棄してモーダルを閉じる

---

### 設定後の表示

- 設定が完了すると、概算料金セクションに合計金額欄に「/ 予算額(予算)」が追記されます。

- 例:`141,642 円 / 140,000 円(予算)`

---

## ユーザーガイド/SkyWay コンソール/プロジェクト詳細

Path: user-guide_console-site_project-detail.md

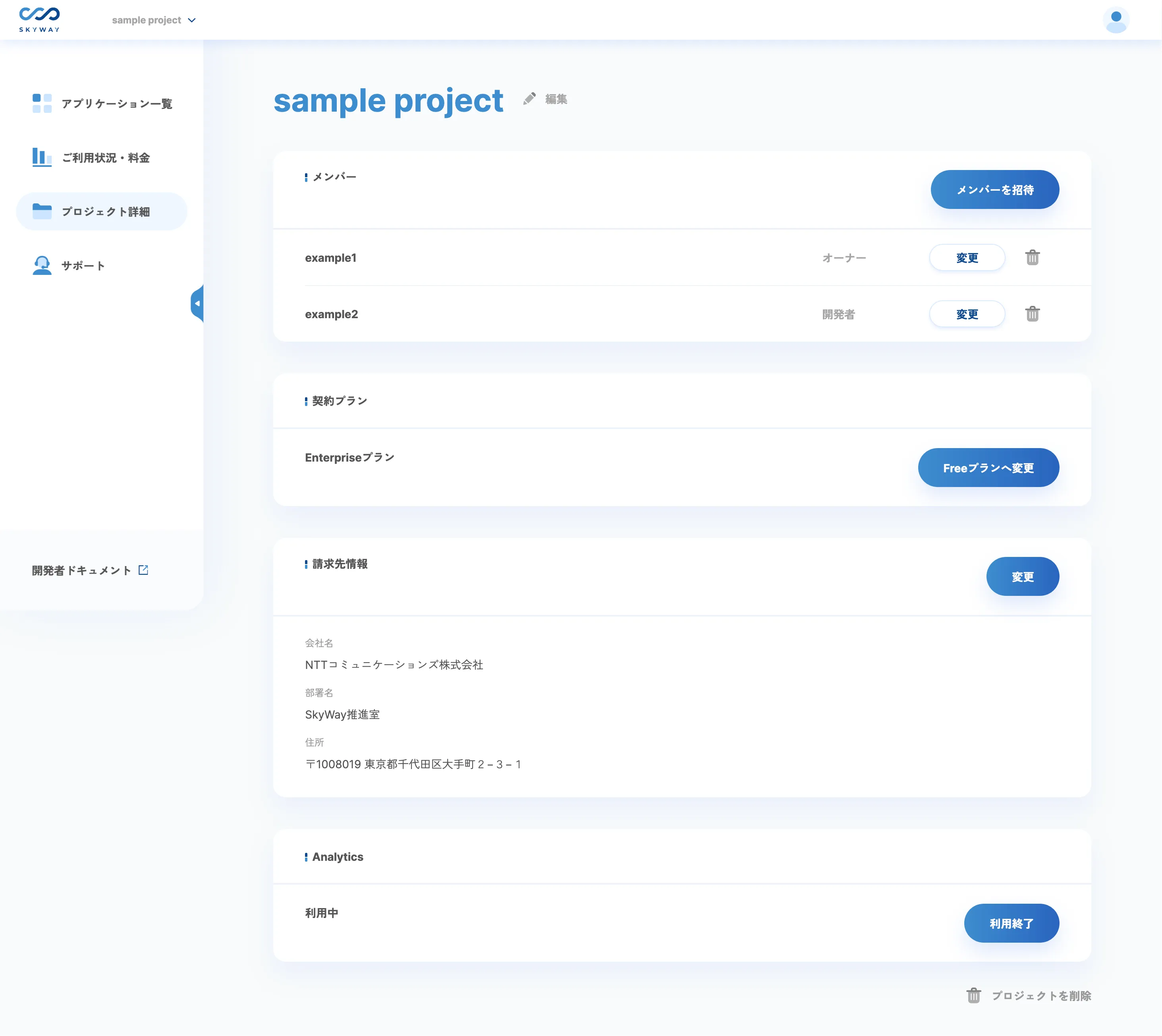

## プロジェクト詳細

プロジェクト全体の設定・メンバー管理・請求情報などを一元管理できる画面です。

以下のセクションで構成されています。

---

### メンバー管理

- **メンバー一覧**:

プロジェクトに所属するユーザーが一覧表示されます。

- 表示項目:

- ユーザー名

- ロール

- 操作:

- **変更**:メンバーロールを編集できます。

- **ゴミ箱アイコン**:メンバーをプロジェクトから削除します。

- **メンバーを招待**:

画面右上の `メンバーを招待` ボタンをクリックすると、メールでユーザーを招待できます。

#### ロール権限一覧

| 機能カテゴリ | 機能項目 | オーナー | 管理者 | 開発者 | オペレーター |

|----------------|--------------------|--------------|--------------|--------------|--------------|

| **プロジェクト管理** | プロジェクトの新規作成 | ✔️ (全員付与)[1] | ✔️ (全員付与)[1] | ✔️ (全員付与)[1] | ✔️ (全員付与)[1] |

| | プロジェクト編集/削除 | ✔️ | ❌[2] | ❌ | ❌ |

| | プラン/請求情報の変更 | ✔️ | ❌ | ❌ | ❌ |

| | メンバーのアカウント作成・編集・削除 | ✔️ | ✔️[3] | ❌ | ❌ |

| | データ利用量・概算料金の確認 | ✔️ | ✔️ | ✔️ | ✔️ |

| | 予算アラートの設定・受信 | ✔️ | ✔️ | ❌ | ❌ |

| **アプリケーション管理** | アプリケーションの作成・編集・削除 | ✔️ | ✔️ | ❌ | ❌ |

| | 利用/停止切替・シークレット再生成 | ✔️ | ✔️ | ❌ | ❌ |

| | シークレットキーの確認 | ✔️ | ✔️ | ✔️ | ❌ |

| | アプリ利用量の確認 | ✔️ | ✔️ | ✔️ | ✔️ |

| **Analytics** | Analytics の確認 | ✔️ | ✔️ | ✔️ | ✔️ |

| **アカウント管理** | メールアドレス変更 | ✔️ | ✔️ | ✔️ | ✔️ |

| | パスワード変更 | ✔️ | ✔️ | ✔️ | ✔️ |

| | 二段階認証用電話番号登録 | ✔️ | ✔️ | ✔️ | ✔️ |

**脚注**

- [1]プロジェクトを作成したアカウントに自動的にオーナー権限が付きます。

- [2]プロジェクト名の編集は可、プロジェクトの削除は不可です。

- [3]オーナー権限の付与はできません。

---

### メンバー招待の手順

1. **メールアドレス入力**:

招待したいユーザーのメールアドレスを入力し、`+` ボタンをクリックします。

2. **ロール選択**:

招待するユーザーのロールを選択し、`確認` ボタンをクリックします。

3. **招待内容の確認・送信**:

内容を確認し、`送信` ボタンをクリックすると、対象ユーザーに招待メール(件名:【SkyWay】プロジェクトに招待されました / You've received invitation to project)が送信されます。

4. **招待承認**:

招待メール内のリンクから登録手続きを完了すると、メンバーとしてプロジェクトに参加できます。

---

### 契約プラン

- **現在のプラン**:

現在契約中のプラン名が表示されます。

- **プラン変更**:

- `Enterpriseプランへ変更` ボタンから、Enterprise プランをご契約いただけます。

- `Freeプランへ変更` ボタンから、現在のプランを Free プランに変更できます。

---

### 請求先情報

Enterprise プラン(有料版)のみ表示されます。

- **会社名・部署名・住所**:

請求書に記載される情報をまとめて表示。

- **編集**:

`変更` ボタンから請求先情報を更新できます。

---

### Analytics 利用状況

- **利用中/未利用**:

Analytics の利用状況が表示されます。

- **利用開始**:

`利用開始` ボタンをクリックすると、Analytics が有効化されます。

- Enterprise プランの場合は料金が発生します。

- **利用終了**:

`利用終了` ボタンで Analytics を停止できます。

---

### プロジェクト削除

- 画面最下部の **「プロジェクトを削除」** リンクから、プロジェクト全体を完全に削除できます。

- 削除操作は復元できないため、実行前に十分ご注意ください。

---

## ユーザーガイド/SkyWay コンソール/サポートページ

Path: user-guide_console-site_support.md

## サポート

「サポート」では、 以下の 2 つのサポート窓口を用意しています。

---

### ご相談・お問い合わせ

- **操作手順**:

1. 「フォームを開く」ボタンをクリックします。

2. 表示されたご相談・お問い合わせフォームに必要事項を記入・送信します。

---

### テクニカルサポート

> **※テクニカルサポートは Enterprise プラン(有料版)ご契約者のみご利用いただけます。**

- **操作手順**:

1. 「チケットを作成する」ボタンをクリック

2. 問題の詳細や再現手順を記載のうえ、送信

---

---

## ユーザーガイド/SkyWay コンソール/アカウント情報

Path: user-guide_console-site_account.md

## アカウント情報

ユーザー個人のアカウントに関する情報を確認・編集できる画面です。メールアドレスやパスワード、多要素認証の管理を行います。

---

### アカウント名

プロジェクト詳細画面のメンバー一覧などで使用されるアカウント名です。

`編集` ボタンから変更できます。

---

### メールアドレス

登録済みのメールアドレスを確認できます。

SkyWay からのお知らせメールの受信設定も切り替え可能です。

`再設定` ボタンからメールアドレスの変更手続きを開始できます。

---

### パスワード

安全のため伏せ字で表示されます。

`再設定` ボタンをクリックすると、パスワード変更用メールが送信されます。

---

### 多要素認証(MFA)

アカウントのセキュリティを強化するため、以下 2 種類の MFA をサポートしています。

アカウントの安全性向上のため、設定を強く推奨します。

| 認証方式 | 説明 |

|-----------|------------------------------------------------------------------------------------|

| 認証アプリ(推奨) | スマートフォンの認証アプリ(例:Google Authenticator など)でワンタイムコードを生成し、ログイン時に入力します。セキュリティが高く推奨されます。 |

| SMS 認証 | 登録した携帯電話番号宛に送信されるワンタイムコードをログイン時に入力します。認証アプリが利用できない場合にご利用ください。 |

- **設定解除**:不要になった認証方式を解除できます。再度有効化する場合は、もう一度設定を行ってください。

---

### アカウント削除

画面最下部の **「アカウントを削除」** から、アカウントを完全に削除できます。

削除後はデータの復旧ができませんので、実行前にご注意ください。

---

## ユーザーガイド/その他 共通仕様/通信要件

Path: user-guide_commons_communication-requirements.md

# 通信要件

SkyWay を利用する際の通信要件は以下のとおりです。

## コントロールプレーン

### RTC APIサーバー向け通信

| 通信方向 | プロトコル | ポート番号 | サーバーアドレス | 用途 |

| --- | --- | --- | --- | --- |

| クライアント→サーバー | TCP (https/wss) | 443 | rtc-api.skyway.ntt.com | コントロールプレーンの操作 |

## P2P

### シグナリングサーバー向け通信

| 通信方向 | プロトコル | ポート番号 | サーバーアドレス | 用途 |

| --- | --- | --- | --- | --- |

| クライアント→サーバー | TCP (https/wss) | 443 | signaling.skyway.ntt.com | P2P通信のためのシグナリング |

### クライアント端末同士のP2P通信

| 通信方向 | プロトコル | ポート番号 | クライアントアドレス | 用途 |

| --- | --- | --- | --- | --- |

| クライアントA→クライアントB | UDP | 1024〜65535の間で動的に決まる | 動的に決まる | P2Pによるデータ、メディアの通信 |

| クライアントB→クライアントA | UDP | 1024〜65535の間で動的に決まる | 動的に決まる | P2Pによるデータ、メディアの通信 |

## STUN/TURN

STUN/TURNサーバーを利用する場合、まずクライアントはURL提供サーバーにリクエストを送り、STUN/TURNサーバーの接続先URLを取得します。

その後、取得したURLを使用して、STUNリクエストまたはTURN接続を開始します。

### URL提供サーバー向け通信

| 通信方向 | プロトコル | ポート番号 | サーバーアドレス | 用途 |

| --- | --- | --- | --- | --- |

| クライアント→サーバー | TCP(https) | 443 | ice-params.skyway.ntt.com | STUNサーバー、TURNサーバーのURLを取得する |

### STUN/TURNサーバー向け通信

| 通信方向 | プロトコル | ポート番号 | サーバーアドレス | 用途 |

| --- | --- | --- | --- | --- |

| クライアント→サーバー | UDP or TCP | 443 | *.skyway.ntt.com | 自分自身のグローバルIP、ポート番号を問い合わせる。また、P2P通信が確立できない場合に、通信を中継する。 |

通信相手の環境によっては、TURNサーバー向け通信時に一部の経路でUDP(ポート15000-65535)が使用される場合があります。

Enterpriseプランをご契約中でご希望の方には、TURNサーバーのIPアドレスリストをご提供いたします。

こちらの[お問い合わせフォーム](https://support.skyway.ntt.com/hc/ja/requests/new?ticket_form_id=19013322121113)からお申し込みください。

## SFU

### SFUサーバー向けシグナリング用通信

| 通信方向 | プロトコル | ポート番号 | サーバーアドレス | 用途 |

| --- | --- | --- | --- | --- |

| クライアント→サーバー | TCP(https) | 443 | sfu.skyway.ntt.com | SFUサーバーとのシグナリング |

### SFUサーバー向けメディア用通信

| 通信方向 | プロトコル | ポート番号 | サーバーアドレス | 用途 |

| --- | --- | --- | --- | --- |

| クライアント→サーバー | UDP or TCP | 33000-34000 | 動的に決まる | SFU向けのメディアの通信 |

## Analytics

| 通信方向 | プロトコル | ポート番号 | サーバーアドレス | 用途 |

| --- | --- | --- | --- | --- |

| クライアント→サーバー | TCP (https/wss) | 443 | analytics-logging.skyway.ntt.com | 通信ログ収集サーバーに向けた通信ログの送信 |

## AI Noise Canceller

| 通信方向 | プロトコル | ポート番号 | サーバーアドレス | 用途 |

| --- | --- | --- | --- | --- |

| クライアント→サーバー | TCP (https) | 443 | noise-cancelling.skyway.ntt.com | モデルダウンロードURLの取得とログの送信 |

モデルダウンロードのために Google Cloud Storage へのリクエストが発生します。

---

## ユーザーガイド/その他 共通仕様/対応コーデック

Path: user-guide_commons_codecs.md

# 対応コーデック

## 概要

SkyWay ではやりとりする音声や映像などのメディアのコーデックをユーザが指定できます。

音声コーデックは Opus がデファクトスタンダードとなっており、現状そのほかに選択の余地はありません。一方で、映像コーデックは VP8や H264などのさまざまなコーデックを(消費電力や映像品質などの)重視する特性やデバイスに応じて選択することで、ユーザのプロダクトに合わせた最適化を行うことができます。

## 分類

SkyWay で利用可能なコーデックは、サポートコーデックと指定可能コーデックの2つに分類されます。

サポートコーデックはコーデックに重大な Issue が見つかった場合やブラウザ/SDK のアップデートの場合に動作検証を行い、問題があった場合に対応します。

指定可能コーデックはリリース時には動作確認を行いますが、サポートコーデックと違い定期的な動作検証を行いません。

また、P2P の場合と SFU の場合でも利用できるコーデックは異なります。

## サポートコーデック

### P2P

#### JavaScript/iOS/Android SDK共通

- 映像コーデック

- H264

- VP8

- VP9

- 音声コーデック

- Opus

#### Linux®︎ SDK

- 映像コーデック

- VP8

- VP9

- 音声コーデック

- Opus

### SFU

#### JavaScript SDK

- 映像コーデック

- H264

- VP8

- 音声コーデック

- Opus

#### iOS/Android SDK

- 映像コーデック

- VP8

- 音声コーデック

- Opus

## 指定可能コーデック

### P2P

#### JavaScript/iOS/Android/Linux®︎ SDK共通

- 映像コーデック

- AV1

- 音声コーデック

- Opus/RED

#### JavaScript

- 映像コーデック

- H265(Google Chrome 107以降/Safari 11以降/Microsoft Edge18以降などの一部ブラウザのみ。特定環境においては別途プラグインのインストールなどが必要。)

### SFU

#### JavaScript SDK

- 映像コーデック

- VP9(サイマルキャストには非対応)

## 商標

Linux®︎は、米国およびその他の国における Linus Torvalds の登録商標です。

---

## ユーザーガイド/その他 共通仕様/割り当てと制限

Path: user-guide_commons_quotas-and-limits.md

# 割り当てと制限

SkyWay では、すべてのユーザーに公平かつ安定的にシステムをご利用いただくために、各アプリケーションが使用可能なリソース量に一定の割り当てを定め、リクエストの頻度に制限を設けております。

割り当てと制限は利用される SDK に関わらず、アプリケーション(アプリケーション ID)ごとに適用されます。

## リソースの割り当て

リソースの割り当ては、同時に利用可能なリソース(Room(Channel) と Member、Publication、Subscription)の数を定めるものです。 ユーザーはこれらの割り当て量を超えて、リソースを作成することはできません。リソースの割当を以下の表に示します。

### Roomライブラリを使用する場合

| 割り当ての種類 | P2P Room | SFU Room |

| --- | --- | --- |

| Roomに同時に存在できるMemberの最大数 | 320 | 320 |

| Roomに同時に存在できるPublicationの最大数 | 256 | 128 |

| Roomに同時に存在できるSubscriptionの最大数 | 5120 | 5120 |

| Roomに同時に存在できるRecordingSessionの最大数 | 256 | 256 |

| 1つのMemberが同時にpublishできるPublicationの最大数 | 8 | 8 |

| 1つのMemberが同時にsubscribeできるSubscriptionの最大数 | 128 | 128 |

| 1つのPublicationに同時に紐づけられる(subscribeできる)Subscriptionの最大数 | 320 | Publication に設定した [maxSubscribers](./user-guide/sfu/#38) の値に準ずる |

| 1つのRecordingSessionに同時に紐づけられるPublicationの最大数 | - | 256 |

| 同時に録音・録画可能な1つのMemberのPublicationの最大数 | - | 4 |

| アプリケーションごとに同時に存在できるLiveStreamingSessionの最大数 | - | 3 |

### Coreライブラリを使用する場合

| 割り当ての種類 | |

| --- | --- |

| Channelに同時に存在できるMemberの最大数 | 320 |

| Channelに同時に存在できるPublicationの最大数 | 256 |

| Channelに同時に存在できるSubscriptionの最大数 | 5120 |

| Channelに同時に存在できるRecordingSessionの最大数 | 256 |

| 1つのPersonが同時にpublishできるPublicationの最大数 | 8 |

| 1つのPersonが同時にsubscribeできるSubscriptionの最大数 | 128 |

| 1つのPublicationに同時に紐づけられる(subscribeできる)Subscriptionの最大数 | 320(SFU Bot ライブラリを利用の場合は Publication に設定した [maxSubscribers](./user-guide/sfu/#38) の値に準ずる) |

| 1つのRecordingSessionに同時に紐づけられるPublicationの最大数 | 256 |

| 同時に録音・録画可能な1つのPersonのPublicationの最大数 | 4 |

| アプリケーションごとに同時に存在できるLiveStreamingSessionの最大数 | 3 |

なお、Channel あたりの最大同時 Member、Publication、Subscription 数の制限について、 SFU Bot によって作られたリソースの数は含まれません。

また、Member あたりの最大同時 Publication 数について、SFU Bot は最大で128個まで同時に Publish することが可能です。

LiveStreamingSessionにおいて、DeleteLiveStreamingSessionのプロセスに時間がかかることがあります。この時プロセスが完了していないLiveStreamingSessionもLiveStreamingSession数のカウントの対象となります。 削除プロセス中にLiveStreamingSession数の最大値の制限によってPrepareLiveStreamingSessionのリクエストに失敗することがあります。その場合は削除の完了を待つため数分おいて再度リクエストを送信してください。

## リクエストレートの制限

リクエストレートの制限は、SkyWay のサーバーに対して実行可能なリクエストの数を定めるものです。リクエストレートの制限は、以下の表に示す通りです。

| 制限 | 制限値 |

| ------------------------------------------------- | ------ |

| 1秒あたりの最大Channel作成リクエスト数 | 50 |

| Channelごとの1秒あたりの最大リクエスト数 | 500 |

| SkyWay Recording APIのアプリケーションごとの1秒あたりの最大リクエスト数 | 20 |

| SkyWay LiveStreaming APIのアプリケーションごとのprepareSessionの1秒あたりの最大リクエスト数 | 1 |

| SkyWay LiveStreaming APIのアプリケーションごとのstartSessionの1秒あたりの最大リクエスト数 | 20 |

| SkyWay LiveStreaming APIのアプリケーションごとのgetSessionの1秒あたりの最大リクエスト数 | 20 |

| SkyWay LiveStreaming APIのアプリケーションごとのupdateSessionの1秒あたりの最大リクエスト数 | 3 |

| SkyWay LiveStreaming APIのアプリケーションごとのdeleteSessionの1秒あたりの最大リクエスト数 | 1 |

Channel ごとの1秒あたりの最大リクエスト数は、Member の入室や退室、Metadata の変更の他、Channel 内の Publication や Subscription などのリソースに対するすべてのリクエストが対象となります。

この制限は、リクエストが SDK によるものか SkyWay Channel API によるものかに関わらず適用されます。

## Channelの有効期限

Channel は作成した時点より7日間有効で、有効期限が延長されることはありません。

Channel の削除をせずに利用を続けて有効期限を迎えた場合、通話の途中で接続が切れる可能性があります。

これを防ぐために、同じ Channel を長期間使い続けるのではなく、ユーザーが居なくなったタイミングで Channel を削除するといった実装をおすすめします。

## Channel、Memberのnameとして使用可能な文字種

Room(Channel)、Memberにはそれぞれ任意のnameを設定することができますが、使用可能な文字種・文字数に制限があります。

制限の内容は以下のとおりです。

| 制限の種類 | 制限の内容 |

| ------ | -- |

| 使用可能な文字種 | `a-z`, `A-Z`, `0-9`, `-`, `.`, `_`, `%`, `*` で構成された文字のみ |

| 文字数 | 1~128文字(0文字は許容されない) |

ただし、 `*` 単体を指定することはできません。

## Channel、Memberのmetadataとして使用可能な文字種

Room(Channel)、Memberにはそれぞれ任意のmetadataを設定することができますが、使用可能な文字種・文字数に制限があります。

制限の内容は以下のとおりです。

| 制限の種類 | 制限の内容 |

| ------ | -- |

| 使用可能な文字種 | (アルファベット、数字、記号、日本語等を含む)任意の文字 |

| 文字数 | 0~1024文字 |

## SkyWay Auth Tokenのサイズの制限

SkyWay Auth Tokenは、ヘッダー部、ペイロード部、署名部すべてを含めて、 7 KB 以下である必要があります。

## RecordingSessionの有効期限

RecordingSession は作成した時点より最大7日間有効で、有効期限が延長されることはありません。

RecordingSession の削除をせずに利用を続けて有効期限を迎えた場合、録音・録画が終了し、終了時点までの録音・録画ファイルが保存されます。

なお、RecordingSession に紐づく Channel が削除された場合は、有効期限を待たずに RecordingSession も削除されます。

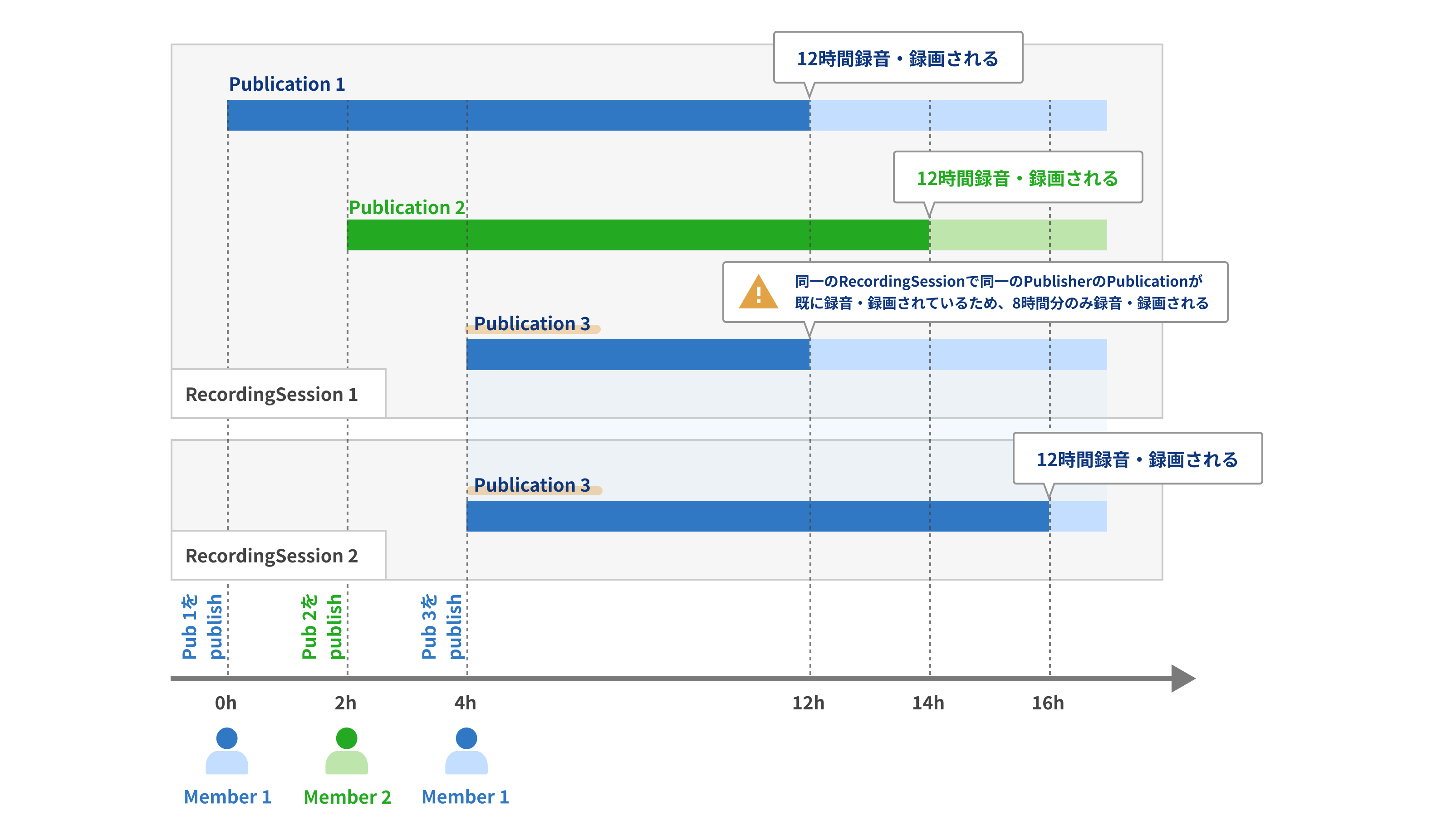

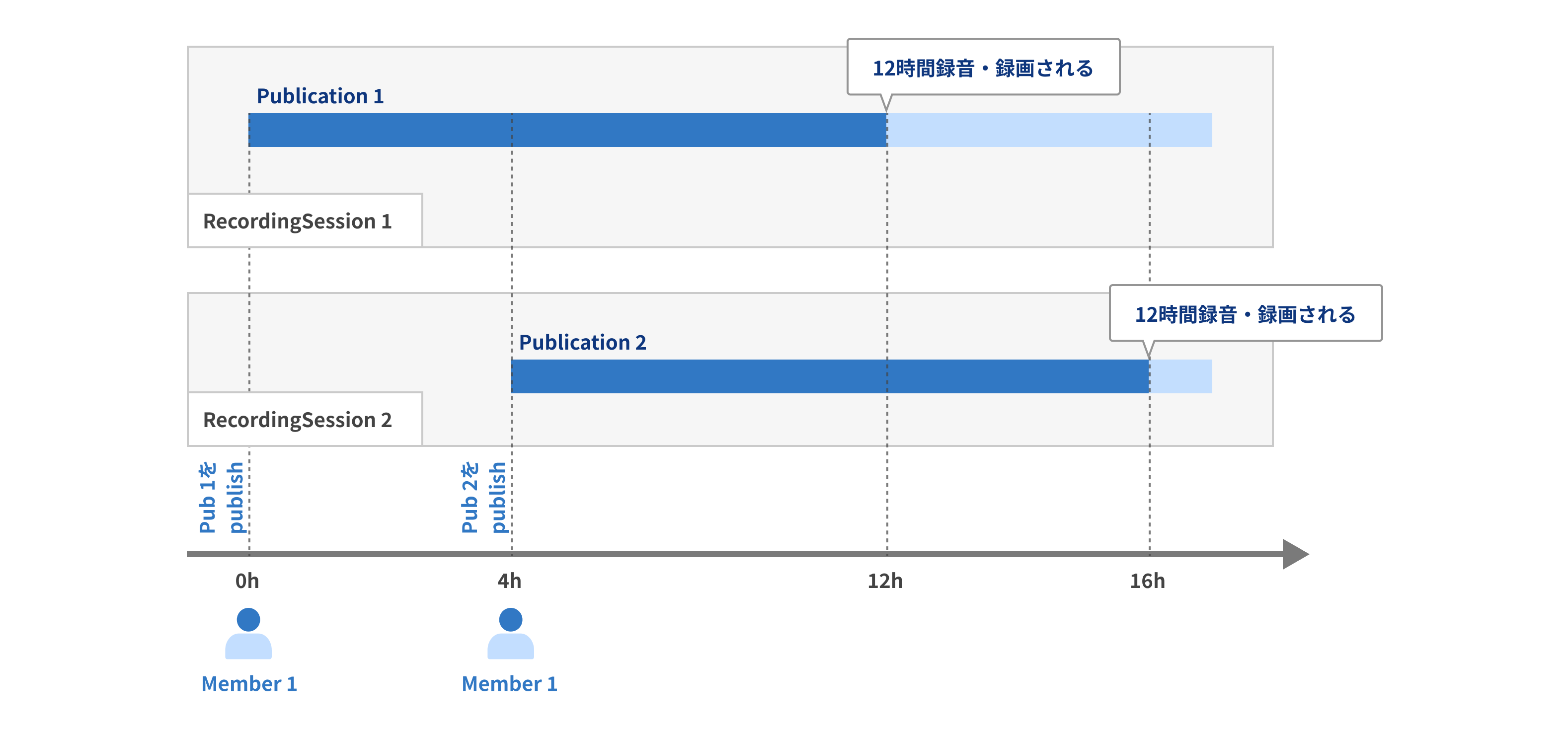

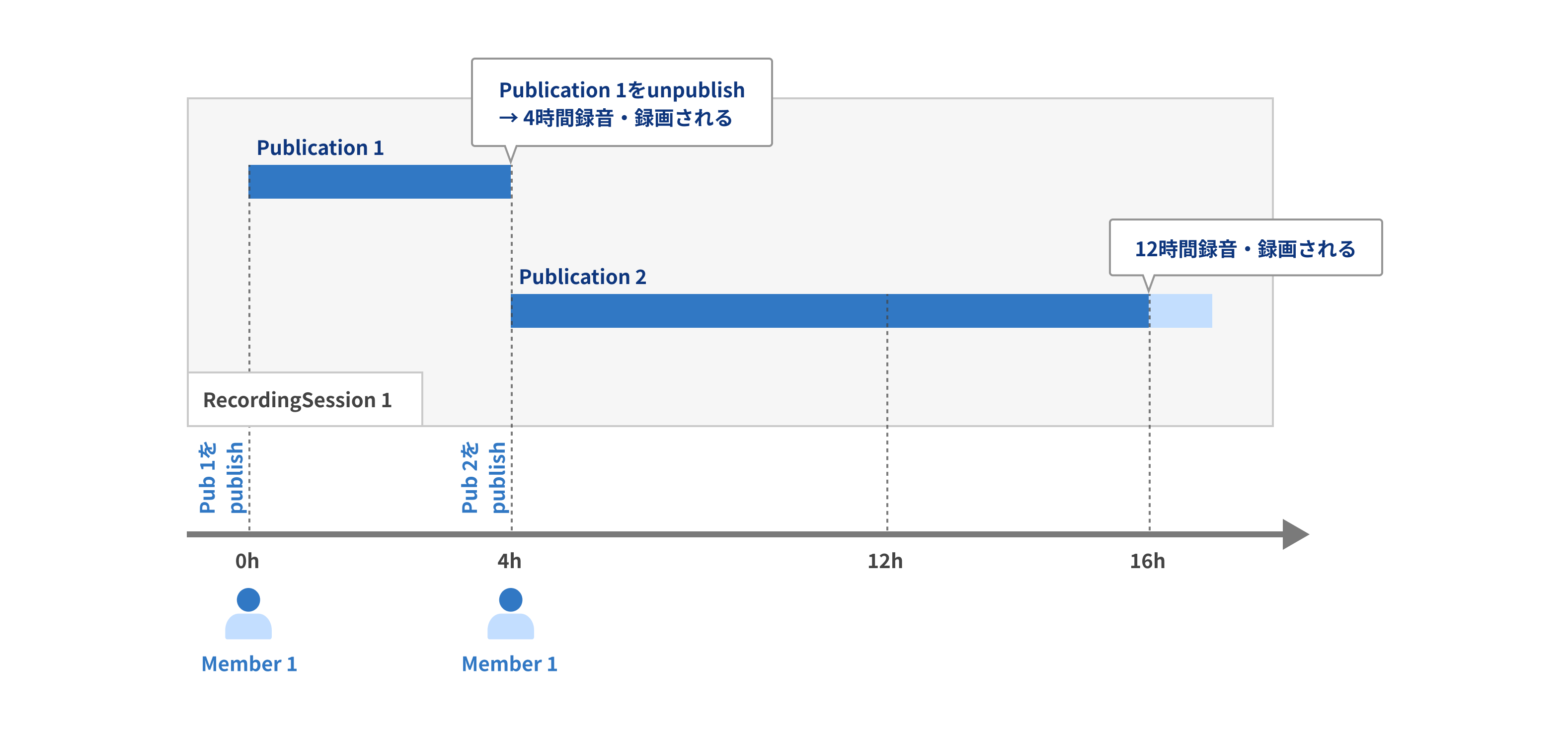

## 録音・録画可能な時間の制限

録音・録画は最小1秒から最大12時間まで行うことができます。

- 開始から1秒以内に終了した録音・録画はファイルとして保存されません。

- 開始から12時間が経過した録音・録画は停止され、クラウドストレージに録音・録画ファイルが保存されます。

なお、以下の場合は、有効期限を待たずに録音・録画が停止されます。

- Publication が unpublish された場合

- Channel が削除された場合

- Channel の有効期限を迎えた場合

- RecordingSession の有効期限を迎えた場合

- 録音・録画中に回復不能なエラーが発生した場合

録音・録画の時間制限は、Publisher および RecordingSession に紐づいてカウントされます。時間制限は、録音・録画対象となる1つ目の Publication の録音・録画が開始されてからカウントが始まります。

録音・録画可能な時間のカウントは、以下のいずれかのタイミングでリセットされます。

- Publisher が leave した

- 録音・録画対象となっている Publication が全て unpublish された

- RecordingSession が削除された

すでに録音・録画が行われている状況で、録音・録画対象となる2つ目以降の Publication が publish された場合でも、制限時間のカウントは継続されます。

したがって、 2つ目以降の Publication については、録音・録画が行われる時間の上限が12時間未満となります。

2つ目以降の Publication を時間の上限まで録音・録画したい場合は、以下のいずれかの対応が必要となります。

- 別の RecordingSession を作成し、新たに録音・録画を行う

- すでに録音・録画中の Publication を全て unpublish した後で、対象となる Publication を publish する

# LiveStreamingSessionの有効期限

LiveStreamingSessionは以下の有効期限を持ちます。

- PREPARINGのステータスでは最大1時間

- StartLiveStreamingSessionのリクエストを送られてから12時間

PrepareLiveStreamingSessionのリクエストが送信されると、LiveStreamingSessionが作成され、最大1時間の待機状態に入ります。この間にStartLiveStreamingSessionのリクエストを送信することで、その時点から最大12時間の配信を開始することができます。

これらの有効期限を迎えた場合、配信は終了し、LiveStreamingSessionは削除されます。

---

## ユーザーガイド/その他 共通仕様/RoomとP2PRoom・SFURoomの併用

Path: user-guide_commons_default-room.md

# RoomとP2PRoom・SFURoomの併用

## 概要

Room(type: default。以下 Room)は P2P 通信と SFU 通信を同一 Room 内で Publish することが可能な新しいタイプの Room です。

Room を使うことで、以下のユースケースに対応できます。

- 録音・録画(SFUを利用)と同時に P2P で通話を行う

- SFU で通話をしながら P2P でデータ通信を行う

- 人数に応じて P2P/SFU での通話を使い分ける

Room は既存の P2PRoom および SFURoom と相互接続が可能であり、アプリ側で段階的に移行することが可能です。

## Roomに対応しているSDK

2025年10月現在、Room に対応している SDK は以下の通りです。

- JavaScript SDK(v2.0.0以降)

- iOS SDK(v3.1.0以降)

- Android SDK(v3.3.0以降)

## P2PRoom/SFURoomとの違い

P2PRoom/SFURoom は、作成した時点で通信方式が固定されます。

P2P と SFU を併用したい場合はそれぞれに対応する Room を作成する必要があり、SkyWay Auth Token や Member などのリソース管理が複雑になる問題がありました。

```javascript

// 通信方式を指定してP2PRoomを作成する

const room = await SkyWayRoom.FindOrCreate(context, { type: "p2p" });

const me = await room.join();

// 通信方式は必ずP2Pになる

await me.publish(audio);

```

一方、Room は作成した時点ではなく、Publish 時に通信方式を指定します。

```javascript

// 作成時点では通信方式が固定されない

const room = await SkyWayRoom.FindOrCreate(context);

const me = await room.join();

// Publish時に通信方式指定する

await me.publish(audio, {type: "p2p"});

// 同一Memberから異なる通信方式でPublishすることもできる

await me.publish(video, {type: "sfu"});

```

このように、1つの Room 内で P2P と SFU を柔軟に併用できます。

## P2PRoom/SFURoomとの相互接続

SDK のアップデート時に、Room を利用するアプリと P2PRoom/SFURoom を利用するアプリが混在するケースがあります。

この場合、Room と P2PRoom/SFURoom を相互に接続することが可能です。

ただし、注意点があります。

Room に対応していないバージョンの SDK において SFURoom から Publish を行った場合、対向の Room からは Publication が2つあるように見えます。

そのため、イベントをハンドリングする際にフィルター処理を行う必要があります。

### JavaScript SDK

```javascript

// Publisher側(SFURoomを使用)

const room = await SkyWayRoom.FindOrCreate(context, { type: "sfu", name: "room1" });

const me = await room.join();

await me.publish(audio);

```

```javascript

// Subscriber側(Roomを使用)

const room = await SkyWayRoom.FindOrCreate(context, { name: "room1" });

const me = await room.join();

room.onStreamPublished.add((e) => {

// P2PのPublicationの場合はスキップする

if (e.publication.type == "p2p") return

me.subscribe(e.publication)

});

```

### iOS SDK

```swift

// Publisher側(SFURoomを使用)

let roomInit: Room.InitOptions = .init()

roomInit.name = "room1"

let room = try? await SFURoom.findOrCreate(with: roomInit)

let me = try? await room?.join(with: nil)

_ = try? await me?.publish(audio, options: nil)

```

```swift

// Subscriber側(Roomを使用)

let roomInit: Room.InitOptions = .init()

roomInit.name = "room1"

self.room = try? await Room.findOrCreate(with: roomInit)

self.room?.delegate = self

self.me = try? await self.room?.join(with: nil)

// MARK: - RoomDelegate

func room(_ room: Room, didPublishStreamOf publication: RoomPublication) {

if publication.type == .P2P {

return

}

Task {

try? await self.me?.subscribe(publicationId: publication.id, options: nil)

}

}

```

### Android SDK

```kotlin

// Publisher側(SFURoomを使用)

val room = SFURoom.findOrCreate(name = "room1")

val me = room?.join(memberInit)

me.publish(audio)

```

```kotlin

// Subscriber側(Roomを使用)

val room = SFURoom.findOrCreate(name = "room1")

val me = room?.join(memberInit)

room?.onStreamPublishedHandler = Any@{

// P2PのPublicationの場合はスキップする

if (it.type == RoomPublication.Type.P2P) return@Any

me.subscribe(it)

}

```

## 通信方式の切り替え

Publish した後に通信方式を変更することはできません。

通信方式を切り替えたい場合は、一度 Unpublish してから再度 type を変更して Publish してください。

---

## ユーザーガイド/用語集

Path: user-guide_terminology.md

# 用語集

## アプリケーション

ユーザーが SkyWay を利用して提供するサービスです。SkyWay は1つのアプリケーションに対して1つのアプリケーション ID とシークレットキーを発行します。

## Bot

Core ライブラリにおいて特殊な目的を持って Channel に Join する、SkyWay サービス側が提供する Member です。現在は多人数通話や映像配信を実現するための SFU Bot が存在し、SkyWay はこれを個別のプラグインパッケージとして提供しています。

## Channel

Core ライブラリにおいて使用されるメディア通信を行うグループの単位です。Channel に含まれる Member は Channel 内にいる他の Member と映像/音声/データの送受信が出来ます。SFU Bot を用いることで大規模な双方向通信を行うことができます。

Channel は一意な識別子である ID と、オプショナルな値である Name を持ちます。ID は Channel 作成時に自動的に払い出される値であり、Name はユーザーが Channel を作成する際に指定できる任意の値です。アプリケーション内で重複した Name を指定することはできません。

## Core ライブラリ

複数人で通信をするアプリケーションを作るためのライブラリです。 JavaScript SDK, Android SDK, iOS SDK それぞれに用意されています。Room ライブラリでカバーできないような、SkyWay によって提供される機能をより細かに制御し最大限に利用したいユースケースに向いています。

## Forwarding

ある Member の Publication を SFU Bot が Subscribe して、その内容を改めて SFU Bot が Publish することで、複数の Member に対して配信を行う操作です。

## LiveStreamingSession

LiveStreamingSessionは、配信機能における配信のセッションのことです。

一つのLiveStreamingSessionにつき一つの配信サービスのエンドポイントに配信できます。

## Member

Channel/Room 内で他のクライアントとの通信を管理するエージェントです。映像や音声を送信したり、受信したりすることが出来ます。Member は一意な識別子である ID と、オプショナルな値である Name を持ちます。

ID は Member 作成時に自動的に払い出される値であり、Name はクライアントが Channel/Room に Join する際に指定できる任意の値です。Channel/Room 内で重複した Name を指定することはできません。

Core ライブラリにおいて、Member は Person と Bot の2種類に分類されます。

## メタデータファイル

録音・録画において、保存した録音・録画ファイルと対応してメタデータを提供しています。メタデータファイルからは録音・録画ファイルの詳しい情報を知ることができます。

## Person

Core ライブラリにおいてコミュニケーションを行うこと自体を目的とする Member です。通常のエンドユーザーが Member として Channel に Join する場合は Person に分類されます。

## P2P

Peer-to-Peer の略で、クライアント同士がサーバーを介さずに直接通信を行う方式です。SkyWay において P2P 方式の通信を行うと SFU 方式と比較してより低遅延で実現できますが、3 人以上での通信において端末のエンコード負荷や上り帯域幅、通信量が多くなるデメリットがあります。複数人通話においてクライアント同士が繋がりあう網目上のネットワークを形成することから、メッシュ方式とも呼ばれます。

## Publish

あるクライアントが映像、音声などの Stream を他の Member が受信可能にするために Channel/Room 内に公開する操作です。Stream を Publish すると Channel/Room 内に Publication というリソースが生成されます。また、Publish を行った Member のことを Publisher と呼びます。

## Publication

Publish の操作によって Channel/Room 内に作られるリソースです。同一 Channel/Room 内の Member はこれを選んで Subscribe することで Stream の受信ができます。どの Member がどのような形式の Stream を Publish しているかの情報が含まれています。

## RecordingSession

RecordingSessionは、どのような Publication をどのクラウドストレージに保存するのかの設定を保持するオブジェクトです。1つの Channel に対して複数作成できます。1つの RecordingSessionには、0個以上の Publication が含まれます。また、1つの RecordingSessionで設定可能なクラウドストレージは1つのみです。

## Room

Room ライブラリにおいて使用されるメディア通信を行うグループの単位です。Room に含まれる Member は Room 内にいる他の Member と映像/音声/データの送受信が出来ます。

通信方式を P2P と SFU の2種類から選択可能です。

Room は一意な識別子である ID と、オプショナルな値である Name を持ちます。ID は Room 作成時に自動的に払い出される値であり、Name はユーザーが Room を作成する際に指定できる任意の値です。アプリケーション内で重複した Name を指定することはできません。

## Room ライブラリ

複数人で通信をするアプリケーションを作るためのライブラリです。JavaScript SDK, Android SDK, iOS SDK それぞれに用意されています。Core ライブラリと比較して、詳細な制御の部分は内包されて簡単に使用できるようになっています。

## SFU

Selective Forwarding Unit の略で、サーバーを経由して通信を行う方式です。3 人以上で通信する際には上りの通信の数を節約でき端末のエンコード負荷と上り帯域幅や通信量を削減できるため、P2P 方式よりも多人数での通話や映像配信を実現できます。

## SFU Bot

Member として Channel に Join し、各 Person から1本の上りトラフィックを受信し、他の Person に対して配信することで SFU 方式を実現する Bot です。

## シグナリングサーバー

通信を開始する前に、IP アドレスやコーデックなど、通信に必要な情報を通信相手と交換するためのサーバーです。

## サイマルキャスト

映像を SFU Bot に Forwarding する際、配信側のクライアントが複数のエンコード設定を指定する機能です。受信側クライアントは自身の通信品質に合わせた画質やフレームレートなど、適したエンコード設定の映像を受け取ることができます。

## SkyWay Auth Token

SkyWay Auth Token とは、利用するクライアントが正当であることを示し、クライアントに必要十分な権限を与えるための JWT(JSON Web Token)形式のトークンです。全てのクライアントは自身の権限に対応した SkyWay Auth Token を取得する必要があります。SkyWay Auth Token の発行にはアプリケーションのシークレットキーが必要となります。

## SkyWay Channel API

SkyWay Channel API は、Channel の作成と取得を行うための API です。JSON-RPC API として提供され、サーバーサイドアプリケーションからリクエストを送ることができます。

## SkyWay LiveStreaming API

LiveStreaming API は、ライブ配信の操作を行うための API です。REST API として提供され、SDK を介さずにリクエストを送ることができます。

## SkyWay Recording API

SkyWay Recording API は、録音・録画の操作を行うための API です。REST API として提供され、SDK を介さずにリクエストを送ることができます。

## Stream

連続して送受信される一連のデータのことです。音声を送信する Audio Stream、映像を送信する Video Stream, 任意のデータを送信する Data Stream があります。

## STUN サーバー

Session Traversal Utilities for NAT の略で、NAT が存在する環境で P2P 通信を行う際に必要なグローバル IP およびポート番号を取得する操作を行うサーバーです。

## Subscribe

ある Channel/Room で Publish されている Stream の受信を開始する操作です。Stream を Subscribe すると Channel/Room 内に Subscription というリソースが生成されます。また、Subscribe を行った Member のことを Subscriber と呼びます。

## Subscription

Subscribe の操作によって Channel/Room 内に作られるリソースです。

どの Member がどの Publication を Subscribe しているかの情報が含まれています。

## TURN サーバー

Traversal Using Relays around NAT の略で、データを中継することで企業ネットワークなど P2P 通信が利用できない特定のネットワーク環境での WebRTC 利用を可能にするサーバーです。

## ユーザー

SkyWay を利用してサービスを提供する事業者です。これに対してアプリケーションを利用する人のことはエンドユーザーと呼びます。

---

## クックブック/JavaScript SDK/画面共有

Path: cookbook_javascript-sdk_screen-share.md

# 画面共有

画面共有の実装方法について説明します。

`SkyWayStreamFactory.createDisplayStreams` 関数を利用します。

> この関数はPCブラウザでのみ利用可能です。

- API リファレンス

https://javascript-sdk.api-reference.skyway.ntt.com/room/classes/StreamFactory.html#createDisplayStreams

```javascript

import {SkyWayStreamFactory} from '@skyway-sdk/room';

const { video } = await SkyWayStreamFactory.createDisplayStreams();

```

また、引数のオプションで、音声の取得や、どの映像を取得するかの設定が可能になります。

```javascript

const { audio, video } = await SkyWayStreamFactory.createDisplayStreams(

{

audio: true, // 音声も取得する

video: {

displaySurface: 'monitor', // 画面全体の映像

}

}

);

```

options 引数はそれぞれ次の値を渡すことができます。

- video

- displaySurface : 共有開始前のポップアップにてデフォルトで選ばれている共有方式

- `"monitor"` : 画面全体

- `"window"` : 特定のウィンドウ

- `"browser"` : 利用しているブラウザのタブ

- audio

- boolean(true/false)

- `true` : `displaySurface: "browser"` の場合にそのタブが発している音声を返り値: audio で取得できます。

- 画面共有時のポップアップにて、「タブの音声も共有する」のトグルが利用可能になるのでユーザ側で操作が必要です。

- この機能は一部の PC 版ブラウザのみ利用可能です。最新の対応状態については以下のリンクを確認してください。

- [mdn web docs:ブラウザの互換性 - Audio capture support](https://developer.mozilla.org/ja/docs/Web/API/Screen_Capture_API/Using_Screen_Capture#%E3%83%96%E3%83%A9%E3%82%A6%E3%82%B6%E3%83%BC%E3%81%AE%E4%BA%92%E6%8F%9B%E6%80%A7)

- `false` : タブが発生する音声の共有機能を利用しません。

- 画面共有時のポップアップにてトグルが出なくなります。

---

## クックブック/JavaScript SDK/カメラ、マイクの選択

Path: cookbook_javascript-sdk_select-devices.md

# カメラ、マイクの選択

### デバイスのリストを取得する

JavaScript SDKの `SkyWayStreamFactory` から提供される、以下のメソッドを利用します。

- `SkyWayStreamFactory.enumerateDevices()`

- `SkyWayStreamFactory.enumerateInputVideoDevices()`

- `SkyWayStreamFactory.enumerateInputAudioDevices()`

- `SkyWayStreamFactory.enumerateOutputAudioDevices()`

---

- APIリファレンス(Roomライブラリ)

- [enumerateDevices()](https://javascript-sdk.api-reference.skyway.ntt.com/room/classes/StreamFactory.html#enumerateDevices)

- [enumerateInputVideoDevices()](https://javascript-sdk.api-reference.skyway.ntt.com/core/classes/StreamFactory.html#enumerateInputVideoDevices)

- [enumerateInputAudioDevices()](https://javascript-sdk.api-reference.skyway.ntt.com/core/classes/StreamFactory.html#enumerateInputAudioDevices)

- [enumerateOutputAudioDevices()](https://javascript-sdk.api-reference.skyway.ntt.com/core/classes/StreamFactory.html#enumerateOutputAudioDevices)

---

- APIリファレンス(Coreライブラリ)

- [enumerateDevices()](https://javascript-sdk.api-reference.skyway.ntt.com/core/classes/StreamFactory.html#enumerateDevices)

- [enumerateInputVideoDevices()](https://javascript-sdk.api-reference.skyway.ntt.com/core/classes/StreamFactory.html#enumerateInputVideoDevices)

- [enumerateInputAudioDevices()](https://javascript-sdk.api-reference.skyway.ntt.com/core/classes/StreamFactory.html#enumerateInputAudioDevices)

- [enumerateOutputAudioDevices()](https://javascript-sdk.api-reference.skyway.ntt.com/core/classes/StreamFactory.html#enumerateOutputAudioDevices)

以下のコードで、映像入力、音声入力、音声出力のデバイスリストを取得できます。

```javascript=

import { SkyWayStreamFactory } from "@skyway-sdk/room";

// 全てのデバイスを取得

const devices = await SkyWayStreamFactory.enumerateDevices();

// 種類ごとにデバイスを取得

const videoInputDevices = await SkyWayStreamFactory.enumerateInputVideoDevices();

const audioInputDevices = await SkyWayStreamFactory.enumerateInputAudioDevices();

const audioOutputDevices = await SkyWayStreamFactory.enumerateOutputAudioDevices();

```

各メソッドを呼び出す前に `createMicrophoneAudioAndCameraStream()` 、`createMicrophoneAudioStream()` 、 `createCameraVideoStream()` のいずれかのメソッドを呼び出してデバイスの使用許可を取得すると、デバイス名を取得できます。

ユーザーがデバイスを区別できるように、デバイス名を表示してデバイスを選択する UI を実装することをお勧めします。

### 入力デバイスを指定する

取得したデバイスの情報のうち、`deviceId` を用いて、入力デバイスを指定できます。

映像、音声のストリームを取得する際に、`deviceId` を指定することで、指定したデバイスからの映像・音声を取得できます。

```javascript=

const selectedVideoInputDeviceId = videoInputDevices[0].deviceId;

const selectedAudioInputDeviceId = audioInputDevices[0].deviceId;

const { audio, video } = await SkyWayStreamFactory.createMicrophoneAudioAndCameraStream({

video: {

deviceId: selectedVideoInputDeviceId

},

audio: {

deviceId: selectedAudioInputDeviceId

}

});

```

### 音声出力デバイスを指定する

音声出力デバイスを指定するには、`setSinkId()` メソッドを利用します。

```javascript=

const selectedAudioOutputDeviceId = audioOutputDevices[0].deviceId;

const mediaElement = document.getElementById('media-element');

await mediaElement.setSinkId(selectedAudioOutputDeviceId);

```

- APIリファレンス

- [HTMLMediaElement: setSinkId() メソッド - Web API | MDN](https://developer.mozilla.org/ja/docs/Web/API/HTMLMediaElement/setSinkId)

---

## クックブック/JavaScript SDK/Canvas映像の利用

Path: cookbook_javascript-sdk_canvas-to-localstream.md

# Canvas映像の利用

JavaScript SDKにおいて、Canvas要素からLocalStreamを作成する方法について説明します。

以下のコードで、Canvas要素に描画されている画像を元にLocalStreamを作成できます。

```html

```

```javascript=

const sourceCanvas = document.getElementById('source-canvas');

const sourceCanvasStream = sourceCanvas.captureStream(30); // 30fpsでキャプチャ

const sourceCanvasVideoTrack = sourceCanvasStream.getVideoTracks()[0];

const localStream = new LocalVideoStream(sourceCanvasVideoTrack);

```

`captureStream()` メソッドの引数には、キャプチャするフレームレートを指定できます。

`captureStream()` メソッドの詳細な挙動については、APIリファレンスを参照してください。

- APIリファレンス

- [HTMLCanvasElement: captureStream() メソッド - Web API | MDN](https://developer.mozilla.org/ja/docs/Web/API/HTMLCanvasElement/captureStream)

- [@skyway-sdk/room MediaStreamTrack から AudioStream / VideoStream を作成する](https://javascript-sdk.api-reference.skyway.ntt.com/room/index.html#md:mediastreamtrack-%E3%81%8B%E3%82%89-audiostream--videostream-%E3%82%92%E4%BD%9C%E6%88%90%E3%81%99%E3%82%8B)

---

## クックブック/JavaScript SDK/ミュートの実装

Path: cookbook_javascript-sdk_enable-disable.md

# ミュートの実装

## 概要

SkyWay でマイクのミュート/アンミュートのような通信の一時的な停止と再開を実装する際に Publication.enable/disable を使うことができます。

Publication.disable()を実行すると Publication のメディア通信が一時的に停止され、Publication.enable()を実行するとメディア通信が再開されます。

Publication.enable/disable は Publication の subscribe/unsubscribe と違って、停止と再開が接続処理を行うことなく、即時に実行される利点があります。

Publication の停止状況は Publication.state プロパティから参照できます。Publication.state は以下の 3 つの状態を取ります。

- enabled

- 配信中。state が disabled の時に enable()を実行すると state が enabled に変更される

- disabled

- 配信停止中。state が enabled の時に disable()を実行すると state が disabled に変更される

- canceled

- 配信終了。Publication が Unpublish されると state が canceled に変更される。

## 制限

Remote の Publication を disable することは可能ですが、enable することはできません。

具体的なユースケースで例えると、話している相手を強制的にミュートさせることはできますが、ミュート中の相手を強制的にアンミュートさせることはできません。

## サンプルコード

JavaScript SDK の Room ライブラリによるサンプルコードを以下に示します。

```ts

const localVideoStream = await SkyWayStreamFactory.createCameraVideoStream();

const publication = await localMember.publish(localVideoStream);

// カメラ映像の配信を一時的に停止する

await publication.disable();

// カメラ映像の配信を再開する

await publication.enable();

```

---

## クックブック/JavaScript SDK/100人規模の会議アプリを作る

Path: cookbook_javascript-sdk_large-scale.md

# 100人規模の会議アプリを作る

参加人数が多く、たくさんの映像を同時にディスプレイに表示するようなアプリケーションを実装する際に、いくつかの事項について注意する必要があります。

本記事では、サンプルアプリケーションを例として参照しつつ、以下の注意点について確認していきます。

- Room の種類の選択

- カメラの Stream の設定

- Publish のオプション

- Subscribe のオプション

- 同時に表示する映像の数

本記事では Room ライブラリを使用してアプリケーションを作成しています。

**サンプルアプリケーション**

[https://github.com/skyway/js-sdk/tree/main/examples/large-room](https://github.com/skyway/js-sdk/tree/main/examples/large-room)

## Room の種類の選択

P2P による多人数通信はメディアの変換処理や通信効率の面で無駄が多く、パフォーマンスの制約が厳しく、大規模な利用には向いていません。

そのため大規模会議アプリを開発する際には必ず SFU Room を利用する必要があります。

SFU Room は次のように作成できます。

_App.tsx L21_

```tsx

const context = await SkyWayContext.Create(tokenString, contextConfig);

const room = await SkyWayRoom.FindOrCreate(context, {

name: roomName,

type: "sfu",

});

const member = await room.join();

```

## カメラの Stream の設定

大規模会議アプリケーションでカメラとマイクの Stream を取得する際の推奨する設定について説明します。

カメラとマイクの Stream は以下のように取得しましょう。

_App.tsx L30_

```tsx

const { audio, video } = await SkyWayStreamFactory.createMicrophoneAudioAndCameraStream({

video: { height: 640, width: 360, frameRate: 15 },

});

```

カメラの Stream については次のような設定を指定しています。

```tsx

{ height: 640, width: 360, frameRate: 15 }

```

解像度 640×360 15 fps というのは一般的な Web カメラの映像を表現する品質として十分なので、このレベルの画質を基準にカメラの Stream の設定をすることをおすすめします。

## Publish のオプション

Stream を Publish して Room 上に公開し、他のユーザーが Stream を受信できるようにします。

以下のように Stream を Publish しましょう。

_App.tsx L33_

```tsx

await member.publish(audio, { maxSubscribers: 50 });

await member.publish(video, {

maxSubscribers: 50,

encodings: [

{ scaleResolutionDownBy: 4, id: "low", maxBitrate: 100_000 },

{ scaleResolutionDownBy: 1, id: "high", maxBitrate: 400_000 },

],

});

```

それぞれの設定項目について見ていきます。

### maxSubscribers

audio,video ともに適切な maxSubscribes の値を設定する必要があります。この値が会議の最大同時参加者の数となります。

### サイマルキャスト

サイマルキャストはクライアントがいくつかの異なる画質の映像を同時に公開できる機能です。

受信側はネットワーク環境に合わせて自動的に画質を選択するか、明示的に画質を選択して受信できます(動画配信サービスの画質選択設定と同じイメージです)。

自動的に画質を選択する場合は少し時間がかかるので、

大規模会議のような、予め高画質な映像を受信するとパフォーマンスに影響が出るとわかっている場合は、はじめから低画質設定を明示的に指定することでユーザー体験を改善できます。

サンプルアプリケーションでは Video の Stream を Publish する際に以下のようにエンコード設定を設定しています。

エンコード設定の設定の数は 2 つまでを推奨しています。3 つ以上設定したとしてもデバイスの負荷状況によっては 3 つ目以降の設定が無視されることがあるからです。

```tsx

encodings: [

{ scaleResolutionDownBy: 4, id: "low", maxBitrate: 80_000, maxFramerate: 5 },

{ scaleResolutionDownBy: 1, id: "high", maxBitrate: 400_000, maxFramerate: 30 },

],

```

iOS/Android SDK においては maxFramerate を複数指定することはできません。

それぞれの設定項目について見ていきます。

- **scaleResolutionDownBy**

- scaleResolutionDownBy では映像の元の解像度に対して何分の 1 の解像度に変換するかを指定できます。元の解像度が 640×360 の映像で仮に 4 を入れると 4 分の 1 の解像度である 160×90 の映像が公開されます。

- **maxBitrate**

- 各エンコード設定のビットレートは maxBitrate の値(bps)に制限されます。

- **maxFramerate**

- 各エンコード設定のフレームレートは maxFramerate の値に制限されます。

- iOS/Android SDK においては複数指定することはできません。

- **id**

- 各エンコードの設定には識別用の ID を入れる必要があります。

次にサンプルアプリケーションが設定している値について詳細に解説します。

#### 解像度の設定(scaleResolutionDownBy)

会議の参加者が少ないうちは、映像の描画負荷は問題にはなりませんが、参加者が増えてくるとその負荷は無視できなくなってきます。

最大 50 人の会議アプリケーションでグリッド状に全参加者(自身を除いた 49 人分)の映像を表示する場合、ユーザーのデバイスの総描画解像度は以下のようになります。

```

7*640 = 4480

7*360 = 2520

4480x2520

```

一般的な PC のディスプレイの解像度は 1920×1080 であることが多く、総描画解像度がデバイスの解像度を大きく上回っており、デバイスに無駄な描画負荷がかかってしまいます。

そこで描画負荷を軽減するために多人数表示用のエンコード設定を追加する必要があります。

このサンプルアプリケーションでは多人数表示用のエンコード設定の scaleResolutionDownBy を 4 に設定しています。

これにより総描画解像度は以下のようになります。

```

7*640/4=1120

7*360/4=630

1120x630

```

動作対象とするクライアントデバイスの性能やアプリケーションの要件に合わせて scaleResolutionDownBy の値は調整してください。

常に総描画解像度がクライアントのデバイスの描画領域の解像度を上回ることのないようにすることが重要です。

#### ビットレートの設定(maxBitrate)

回線速度の低い環境で快適に大規模会議を利用できるようにするために、通信量について考慮する必要があります。

最大 50 人の会議アプリケーションで全参加者(自身を除いた 49 人分)の映像(400kbps)をユーザーのデバイスに表示する場合下りの通信量は以下のようになります。

```

400kbps * 49 = 19.6mbps

```

モバイル回線のような環境では 5mbps 程度の速度しかないことが想定されるので、

全参加者を表示した状態で正常にアプリケーションを利用できるようにするためにはビットレートを制限する必要があります。

このサンプルアプリケーションでは多人数表示用のエンコード設定の maxBitrate を 80kbps に設定しています。

これにより通信量は以下のようになります。

```

80kbps * 49 = 3.92mbps

```

動作対象とするネットワーク環境に合わせて maxBitrate の値は調整してください。

クライアントのデバイスの通信帯域を上回る量の通信を行うと、輻輳が発生し、一時的に映像や音声が停止するなどの問題が発生するので、注意する必要があります。

モバイル端末上では同時に表示する映像の数を PC より少なくするなどの最適化を適宜行ってください。

#### フレームレートの制限(maxFramerate)

映像の滑らかさと描画負荷のバランスを取るために、フレームレートの制限も重要な設定となります。

フレームレートが高いほど映像は滑らかになりますが、それに伴い描画負荷も増えます。特に多人数の会議では、各参加者の映像を描画するための負荷が大きくなるため、適切なフレームレートの制限が必要となります。

このサンプルアプリケーションでは多人数表示用のエンコード設定の maxFrameRate を 5 に設定しています。

これにより、各参加者の映像は最大で秒間 5 フレームで表示され、描画負荷を抑えることができます。

動作対象とするクライアントデバイスの性能やアプリケーションの要件に合わせて maxFrameRate の値は調整してください。

フレームレートが高すぎると、デバイスの描画負荷が増え、パフォーマンスが低下する可能性があります。逆に、フレームレートが低すぎると映像が不自然に見える可能性があります。適切なバランスを見つけることが重要です。

## Subscribe のオプション

ビデオを Subscribe する際に `preferredEncodingId` に Publish した際に設定したエンコード設定の ID を指定することで指定した ID のエンコード設定で Subscribe できます。

サイマルキャストによる画質の自動選択にはラグがあり、大規模会議で全参加者の映像を表示する場合や、性能の低いモバイル端末でアプリケーションを利用する場合は、一時的に映像や音声が停止する可能性があります。

そういったケースでは、予め低画質設定を指定して Subscribe することで、問題を回避できます。

サンプルアプリケーションでは次のように低画質設定を選択して Subscribe するようにしています。

_App.tsx L63_

```tsx

const subscribe = async (publication: RoomPublication) => {

if (publication.publisher.id !== member.id) {

if (publication.contentType === "video") {

await member.subscribe(publication, { preferredEncodingId: "low" });

} else {

await member.subscribe(publication);

}

}

};

```

### Subscription のエンコード設定の切り替え

Stream を Subscribe した後、Subscription の映像のエンコード設定を切り替えたい場合は次のようにします。

_App.tsx L103_

```tsx

const switchEncodingSetting = async () => {

if (subscription.preferredEncoding === "high") {

subscription.changePreferredEncoding("low");

} else {

subscription.changePreferredEncoding("high");

}

};

```

changePreferredEncoding で変更したいエンコード設定の ID を指定すると Subscription のエンコード設定がその設定にただちに切り替わります。

会議の参加人数に合わせて受信映像の品質設定を変更するなどの工夫を施すのも有効な手段です。

## 同時に表示する映像の数

解像度やビットレートを抑制したとしても、大量の映像を同時にデコードするのは端末に対して大きな負荷がかかります。サービスがサポートする対象の端末の性能に合わせて同時に表示する映像の数は制限する必要があります。

オンライン研修などの数十人以上のユーザーがビデオをオンにして利用するケースで、ページネーションは端末への負荷を軽減する非常に有効な手段です。

数十人のうち同時に 4×4 人や 5×5 人を同時に表示し、それ以降のユーザーはページ変更ボタンを押した際に表示するよう実装することで端末の負荷を大幅に軽減できます。

## まとめ

この記事のサンプルアプリケーションで行った最適化事項についてまとめると以下のようになります。

- SFU を使う

- カメラの解像度を用途に合わせて制限する

- Publish のオプション指定

- maxSubscribers

- 会議の最大参加者数を指定する

- encodings

- 最大参加者数に合わせて解像度を制限する (scaleResolutionDownBy)

- 最大参加者数に合わせてビットレートを制限する (maxBitrate)

- 設定の識別用の ID を設定する

- Subscribe のオプション